Linux 网络驱动程序是操作系统内核中负责管理网络硬件设备与上层协议栈之间通信的核心组件,它作为硬件抽象层,将物理网卡等网络设备的功能转换为内核网络子系统可识别的标准接口,实现了设备硬件特性与协议栈的解耦,Linux 网络驱动的架构设计遵循分层思想,通常包含网络设备接口层、设备驱动功能层、网络协议接口层三个主要层次,这种分层结构确保了驱动的模块化和可移植性。

Linux 网络驱动的核心架构与工作原理

网络设备接口层是驱动与内核网络子系统的交互接口,主要由 struct net_device 结构体定义,该结构体包含了设备的名称(如 eth0)、硬件地址(MAC)、操作函数集合(如 open、stop、start_xmit)等关键信息,当内核需要发送数据时,协议层通过 dev_queue_xmit() 将数据包传递给驱动的 ndo_start_xmit 函数;接收数据时,驱动通过 netif_rx() 或 napi_gro_receive() 将数据包提交给协议栈。

设备驱动功能层是驱动的核心实现,直接操作硬件寄存器,管理硬件的初始化、数据收发、中断处理等,在驱动初始化阶段,通过 request_irq() 注册中断处理函数,在数据接收完成后,通过 DMA 将数据从网卡缓冲区拷贝到内核内存,并通过 skb(套接字缓冲区)结构体封装后提交给上层,网络协议接口层则负责与 TCP/IP 协议栈对接,处理数据包的路由、转发等逻辑,确保数据能在网络层正确传输。

为提高性能,Linux 网络驱动普遍采用 NAPI(New API)机制,结合轮询和中断两种模式:在数据包较少时,通过中断唤醒驱动处理;当数据量较大时,切换为轮询模式,减少中断开销,提升吞吐量,现代驱动还支持多队列(Multi-Queue)技术,将数据分发到不同的 CPU 核心处理,实现并行收发,充分利用多核 CPU 的性能。

关键数据结构与函数

Linux 网络驱动的实现依赖于一系列核心数据结构和函数。struct net_device 是网络设备的抽象表示,其成员 dev_addr 存储设备 MAC 地址,netdev_ops 指向包含设备操作函数的结构体,如 ndo_open(设备开启)、ndo_stop(设备关闭)、ndo_start_xmit(数据发送)等。

数据收发过程中,sk_buff(简称 skb)是核心数据结构,它封装了网络数据包的头部、数据载荷以及控制信息,驱动通过 alloc_skb() 分配 skb,通过 skb_put()、skb_pull() 等函数调整数据包长度,发送数据时,驱动将 skb 中的数据通过 DMA 拷贝到网卡硬件缓冲区;接收数据时,硬件将数据填充到 skb 后,通过 netif_receive_skb() 提交给协议栈。

中断处理方面,传统驱动使用 request_irq() 注册中断服务程序(ISR),但 ISR 中应尽量减少耗时操作,仅完成数据接收标志的设置,实际数据处理通过 tasklet 或工作队列(workqueue)延迟执行,NAPI 机制通过 napi_schedule() 启动轮询,在 napi_poll() 函数中批量处理数据包,显著降低中断频率。

驱动开发流程与实例

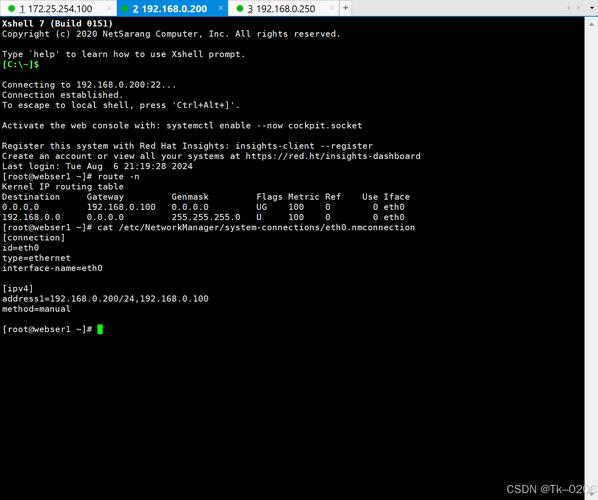

开发 Linux 网络驱动通常需要经过硬件初始化、设备注册、数据收发实现、中断处理等步骤,通过 pci_enable_device()(PCI 设备)或 platform_get_resource()(平台设备)获取硬件资源,设置设备寄存器,初始化 DMA 缓冲区,调用 alloc_etherdev() 分配 net_device 结构体,并填充 netdev_ops 和 ethtool_ops(用于工具接口,如 ethtool)。

以虚拟网卡驱动(如 TUN/TAP)为例,其数据发送函数 ndo_start_xmit 仅需将 skb 传递给用户空间,而物理网卡驱动(如 Intel e1000)则需要通过硬件描述符(Descriptor)将 skb 映射到 DMA 地址,并通知硬件发送,中断处理函数在收到硬件发送完成或接收中断后,更新统计信息(如 net_device 的 tx_packets、rx_packets),并通过 NAPI 机制处理数据包。

性能优化与调试技术

网络驱动的性能优化主要围绕减少 CPU 开销、提升数据拷贝效率展开,零拷贝(Zero-Copy)技术通过 sendfile() 等系统调用,避免数据在内核空间和用户空间之间的多次拷贝;分散-聚集(Scatter-Gather) DMA 支持允许硬件一次性处理多个不连续的内存缓冲区,减少数据包拷贝次数,通过 ethtool 工具可调整驱动参数,如 RX/TQ 队列长度、中断合并(Interrupt Moderation)间隔等,适配不同场景的性能需求。

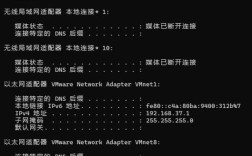

调试网络驱动时,dmesg 命令用于查看内核日志,定位驱动加载或运行时的错误;ethtool -i 可查看驱动版本和相关信息;tcpdump 或 wireshark 抓包工具用于分析数据收发内容,若出现内存泄漏,可通过 /proc/slabinfo 监控 slab 缓冲区使用情况;若发生死锁,则通过 ftrace 或 perf 工具跟踪函数调用链,定位锁竞争问题。

相关问答 FAQs

Q1:Linux 网络驱动中 NAPI 机制如何解决中断风暴问题?

A1:NAPI 通过“中断+轮询”混合模式解决中断风暴,当数据包到达时,硬件触发中断,驱动在中断处理函数中禁用设备中断,并通过 napi_schedule() 启动轮询,轮询过程中,驱动批量处理接收队列中的数据包,处理完成后重新启用中断,这种方式在低负载时通过中断快速响应,高负载时通过轮询减少中断次数,避免因大量数据包导致的中断频繁触发,从而提升系统吞吐量和稳定性。

Q2:如何判断 Linux 网络驱动是否存在内存泄漏问题?

A2:可通过以下方法判断:

- 使用

dmesg查看内核日志,若出现 “slab allocation failed” 或 “Out of memory” 等错误,可能提示内存分配异常; - 检查

/proc/meminfo中Slab和PageTables等指标,若持续增长且不释放,可能存在泄漏; - 使用

slabtop命令监控特定 slab 缓冲区的使用情况,若驱动关联的缓存(如skbuff_head_cache)对象数持续增加,则可能存在未正确释放的 skb; - 使用

valgrind或memcheck工具对驱动进行静态分析,或通过kmalloc/kfree的调试钩子记录内存分配和释放日志,定位未配对的内存操作。