大数据技术作为当今信息时代的核心驱动力,正在深刻改变着数据存储、处理和分析的方式,在海量数据规模、快速处理速度和多样化数据类型的挑战下,传统的数据处理工具已难以满足需求,而Spark的出现为大数据领域带来了革命性的突破,Spark作为一种基于内存计算的开源分布式计算框架,以其高效、通用和易用的特点,迅速成为大数据生态系统中的关键组件,并在各行各业得到广泛应用。

Spark的核心设计理念在于通过内存计算技术大幅提升数据处理性能,与传统的MapReduce等磁盘计算框架不同,Spark将中间数据存储在内存中,减少了磁盘I/O操作,从而显著加快了数据处理速度,Spark的架构主要由核心组件(Spark Core)、Spark SQL、Spark Streaming、MLlib和GraphX等组成,形成了一个统一的数据处理平台,Spark Core是整个框架的基础,提供了任务调度、内存管理、 fault tolerance(容错)等核心功能;Spark SQL则使得用户可以通过SQL语句或DataFrame API进行结构化数据处理,兼容Hive等数据仓库工具;Spark Streaming支持实时数据流处理,能够以微批处理的方式实现准实时分析;MLlib是Spark的机器学习库,提供了丰富的机器学习算法和工具;GraphX则专门用于图计算,支持图数据的并行处理,这些组件协同工作,使得Spark能够从批处理、流处理、机器学习到图计算,覆盖多种数据处理场景。

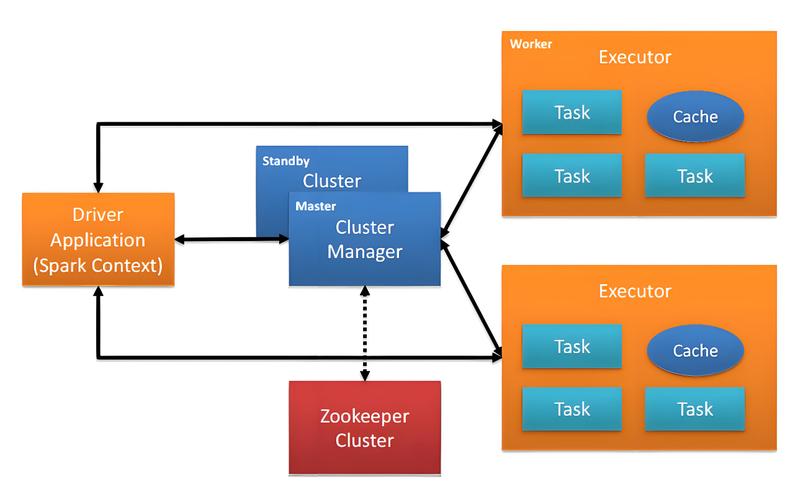

Spark的运行依赖于集群资源管理器,如Hadoop YARN、Apache Mesos或其自带的Standalone模式,在集群部署中,Spark将应用程序分解为多个任务,并在集群中的不同节点上并行执行,RDD(Resilient Distributed Dataset,弹性分布式数据集)是Spark中最基本的数据抽象,它是一个只读的、分区的数据集合,支持转换操作(如map、filter)和行动操作(如count、collect),RDD的容错机制通过血统(Lineage)实现,即每个RDD记录其如何从其他RDD衍生而来,当某个分区数据丢失时,可以通过血统重新计算恢复,从而保证了数据处理的可靠性,Spark还引入了DataFrame和Dataset等高级API,这些API在RDD的基础上提供了类型安全和优化能力,进一步简化了开发流程并提升了性能。

在实际应用中,Spark的性能优势尤为突出,以某电商平台的用户行为分析为例,每天需要处理数TB级别的点击流数据,包括用户ID、商品ID、点击时间、页面位置等字段,通过使用Spark Streaming,平台可以实时接收Kafka中的数据流,进行窗口聚合分析,如统计每分钟热门商品、用户访问路径等,并将结果存储到Redis中供前端实时展示,利用Spark SQL的DataFrame API,可以对历史数据进行复杂查询,例如分析用户购买转化率、商品关联规则等,为营销策略提供数据支持,在机器学习方面,MLlib的协同过滤算法可以构建个性化推荐系统,根据用户的历史行为推荐可能感兴趣的商品,显著提升用户体验和销售额,Spark的内存计算特性使得迭代计算(如机器学习训练)的性能比传统框架提升数十倍,这对于需要多次迭代优化的算法尤为重要。

Spark的生态系统也在不断完善,与其他大数据工具的集成能力不断增强,Spark可以与Hadoop生态系统无缝集成,直接读取HDFS上的数据,并使用Hive的元数据管理;与Kafka、Flume等流数据源结合,实现实时数据采集;与TensorFlow、PyTorch等深度学习框架集成,支持大规模深度学习模型训练,Spark还提供了Python、Scala、Java和R等多种编程接口,降低了开发门槛,使得不同背景的开发者都能快速上手,在企业级应用中,Spark的安全特性(如Kerberos认证、数据加密)和监控管理工具(如Spark UI)也日益成熟,满足了企业对数据安全和运维管理的要求。

Spark并非适用于所有场景,对于极低延迟的实时处理需求(如毫秒级响应),Spark Streaming的微批处理模式可能不如Flink等流处理框架;对于超大规模数据集(如PB级别),如果内存资源不足,Spark的性能优势会被磁盘I/O抵消,在实际应用中需要根据业务需求、数据规模和集群资源选择合适的技术方案,Spark的调优也是一门学问,需要合理设置分区数、内存分配、序列化方式等参数,以充分发挥其性能潜力。

随着大数据技术的不断发展,Spark也在持续演进,Spark 3.0版本引入了动态分区裁剪、自适应查询执行等新特性,进一步提升了SQL性能;对GPU的支持使得计算密集型任务的处理速度得到提升;与云原生技术的结合使得Spark在弹性扩展和资源管理方面更加灵活,Spark将继续在实时计算、机器学习和图计算等领域深耕,与其他大数据技术融合,为智能化决策提供更强大的支持。

相关问答FAQs

问题1:Spark与Hadoop MapReduce的主要区别是什么?

答:Spark与Hadoop MapReduce的主要区别在于计算模型和性能,MapReduce基于磁盘计算,中间结果需要写入磁盘,导致大量I/O开销,适合批处理但速度较慢;而Spark基于内存计算,中间数据存储在内存中,显著减少了磁盘I/O,处理速度更快(尤其在迭代计算场景中,性能可提升10-100倍),Spark提供了统一的平台支持批处理、流处理、机器学习和图计算,而MapReduce主要用于批处理;Spark的API更丰富,支持Scala、Java、Python和R等多种语言,开发效率更高。

问题2:Spark Streaming的微批处理模式与Flink的流处理模式有何不同?

答:Spark Streaming采用微批处理(Micro-batching)模式,将实时数据流划分为小的批次(如1秒),以批处理方式进行处理,延迟通常在秒级;而Flink采用真正的流处理(Streaming)模式,逐条处理数据事件,延迟可达毫秒级,Spark Streaming更适合对实时性要求不高但需要高吞吐量的场景(如日志分析),而Flink更适合低延迟、高实时性的场景(如实时欺诈检测),Spark Streaming的容错机制基于RDD的血统,而Flink通过检查点(Checkpoint)实现状态容错,在复杂状态管理场景下Flink的容错能力更强。