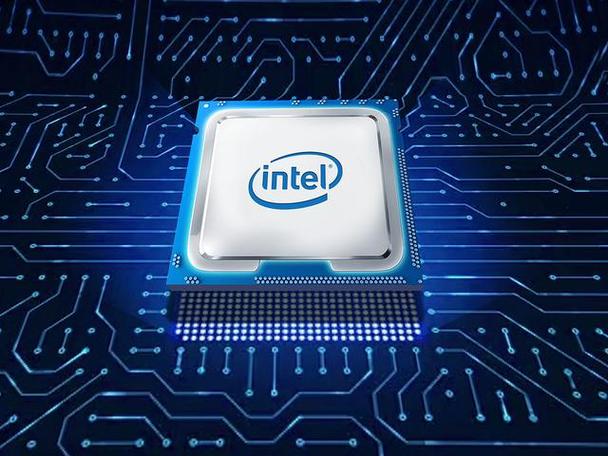

Intel在网络技术领域持续深耕,通过硬件创新、软件定义架构与生态协同,不断推动网络基础设施的变革,近年来,Intel在数据中心网络、边缘计算、5G/6G承载以及智能网卡等领域推出了一系列新技术,旨在提升网络性能、降低延迟、增强安全性,并为AI、云计算、高性能计算等新兴场景提供支撑,以下从核心技术突破、应用场景拓展及生态布局等方面展开详细阐述。

核心技术突破:从硬件加速到软件定义

智能网卡(SmartNIC)与DPU的演进

Intel的智能网卡技术以“数据处理器”(DPU,原称IPU)为核心,通过将网络、存储和安全功能从CPU卸载至专用处理器,显著提升数据中心资源利用效率,最新的Intel® Agilex™ 7 DPU基于10nm工艺,集成高性能FlexRAN处理器、加密引擎和可编程数据包处理单元,支持100G/400G网络带宽,可实现微秒级延迟处理,其关键特性包括:

- 硬件级卸载:支持RDMA、RoCEv2、NVMe-oF等协议,将CPU负载降低40%以上,同时提升存储网络吞吐量。

- 安全隔离:通过硬件级可信执行环境(TEE)和加密加速,实现数据传输与处理的端到端安全防护。

- 可编程架构:支持P4等编程语言,允许用户自定义网络数据处理逻辑,适配多样化业务场景。

400G/800G以太网技术突破

随着数据中心流量爆炸式增长,Intel推出了基于SiPho(硅光子)技术的800G以太网解决方案,该技术通过集成硅光收发器与25.6G SerDes(串行器/解串器),在单端口实现800Gbps带宽,同时功耗控制在200W以下,较传统方案降低30%能耗,Intel的800G以太网控制器支持PCIe 5.0接口,可实现主机与网卡间128GB/s的传输带宽,满足AI集群内部高互联需求。

软件定义网络(SDN)与网络虚拟化

Intel通过Open vSwitch(OVS)加速技术、DPDK(数据平面开发套件)和智能边缘虚拟化平台(Intel® EVPN),构建了完整的软件定义网络架构,DPDK Zero-Copy技术通过旁路内核协议栈,将数据包处理延迟降至亚微秒级;而EVPN结合VxLAN技术,支持跨数据中心的网络虚拟化,实现租户隔离与灵活调度,在5G核心网场景中,Intel的vRAN(虚拟化无线接入网)解决方案通过FlexRAN软件栈,将基带处理功能下沉至边缘服务器,降低5G部署成本50%以上。

网络安全与加密加速

针对日益严峻的网络威胁,Intel集成多种硬件级安全技术:

- Intel® QuickAssist Technology(QAT):提供对称/非对称加密加速,支持AES、RSA、ECC等算法,加密性能提升10倍以上。

- Intel® Trust Domain Extensions(TDX):基于DPU的内存加密技术,实现虚拟机间的数据隔离,防止侧信道攻击。

- 流量加密与完整性校验:通过IPsec offload引擎,自动处理VPN数据包的加密与认证,降低CPU开销。

应用场景拓展:从数据中心到边缘智能

数据中心与高性能计算(HPC)

在AI训练场景中,Intel的Omni-Path架构(HPC网络)与以太网解决方案结合,支持多节点GPU间的高带宽低延迟通信,在气象模拟、药物研发等HPC应用中,通过RDMA over Converged Ethernet(RoCE)技术,将节点间通信延迟控制在1μs以内,数据传输效率提升3倍以上。

5G/6G边缘计算

Intel的FlexRAN方案与边缘服务器(如Intel® Xeon® D系列)结合,实现5G基带功能的云化部署,在智慧工厂场景中,边缘节点通过低延迟网络(5G URLLC)实现毫秒级设备控制,而DPU则负责实时数据处理与安全隔离,确保工业控制系统的可靠性。

云原生与混合云

Intel通过云原生网络加速器(CNF)和Kubernetes网络插件(如Cilium),优化容器网络性能,在混合云环境中,其SD-WAN解决方案支持跨云流量智能调度,结合AI算法实现动态路径选择,降低网络抖动20%以上。

智慧城市与物联网

在智慧城市场景中,Intel的边缘计算网关(如Intel® IoT Gateway)通过5G与Wi-Fi 6E融合,实现千万级IoT设备的高并发接入,其网络切片技术可为不同业务(如智能交通、环境监测)提供差异化SLA保障,确保关键业务的带宽与延迟需求。

生态布局与标准化推进

Intel积极推动开放生态合作,与VMware、Red Hat、NVIDIA等企业共建网络技术联盟,并参与EVPN、CCIX(Compute Express Link)等行业标准制定,在开源社区中,Intel主导了DPDK、OVS等项目的代码贡献,累计提交代码超10万行,推动网络技术开源化与标准化。

未来技术方向

面向2025年及以后,Intel将重点布局以下方向:

- 6T以太网技术:通过SiPho与800G SerDes的升级,实现单端口1.6Tbps带宽,支撑AI集群的万亿参数模型训练需求。

- AI原生网络:将AI引擎嵌入DPU,实现网络流量预测、故障自愈与智能调度,降低运维成本60%。

- 6G网络切片:结合太赫兹通信与边缘计算,为AR/VR、自动驾驶等场景提供微秒级延迟保障。

相关问答FAQs

Q1:Intel智能网卡与传统网卡的核心区别是什么?

A1:传统网卡主要承担数据收发功能,而Intel智能网卡(DPU)集成了可编程处理器与专用加速引擎,可实现网络、存储、安全功能的硬件级卸载,传统网卡需CPU处理数据包加密,而DPU通过QAT硬件加密引擎将性能提升10倍以上,同时支持虚拟化隔离与自定义业务逻辑,显著降低CPU负载并提升系统灵活性。

Q2:Intel网络技术如何解决AI训练中的通信瓶颈问题?

A2:针对AI训练的“通信墙”问题,Intel通过三方面技术突破:① 800G以太网与RDMA over Converged Ethernet(RoCE)技术,实现多GPU节点间200Gbps高带宽、1μs低延迟通信;② 智能网卡DPU的Zero-Copy机制,避免数据在CPU与GPU间的重复拷贝;③ 基于AI的流量调度算法,动态优化参数同步与梯度聚合路径,减少网络拥塞,从而提升AI训练效率30%以上。