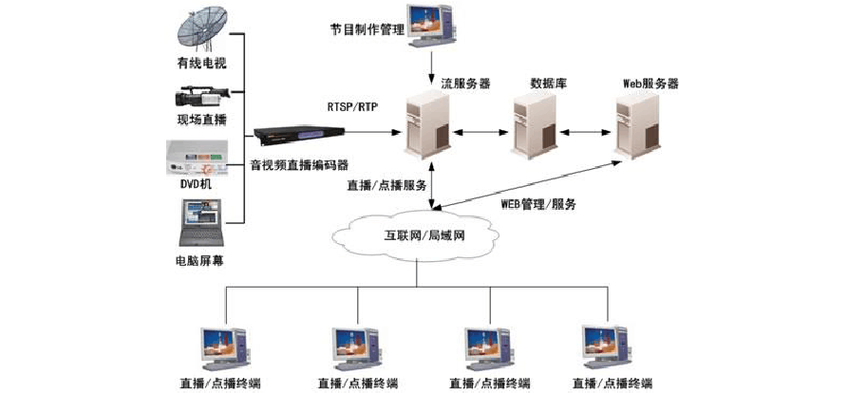

移动视频直播技术架构是一个复杂且高度优化的系统,涉及音视频采集、处理、传输、分发、播放及互动等多个环节,需兼顾低延迟、高并发、流畅性和用户体验,其核心目标是在移动网络波动较大的环境下,实现稳定、高质量的直播服务,以下从技术分层角度详细拆解其架构。

终端层:直播内容采集与预处理

终端层是直播的起点,主要负责音视频信号的采集、编码和初步处理,直接决定直播源的原始质量。

- 采集模块:支持摄像头(后置/前置)、麦克风、屏幕录制等多源输入,需适配不同移动设备的硬件能力(如分辨率、帧率、编码格式),iOS端通常使用AVFoundation框架,Android端则通过Camera2 API或MediaRecorder实现,同时需处理设备横竖屏切换、前后摄像头切换等场景。

- 编码模块:原始音视频数据体积庞大,需通过编码器压缩以降低传输成本,移动端主流采用H.264(AVC)或H.265(HEVC)视频编码,AAC音频编码,支持硬件编码(如Apple的VideoToolbox、Android的MediaCodec)以降低功耗,编码参数需动态调整:弱网环境下降低码率(如从1080p降至720p)、帧率(从30fps降至15fps),通过RC(Rate Control)算法平衡画质与带宽。

- 预处理模块:包括美颜、滤镜、背景虚化、美妆等AI增强功能,通常基于OpenGL ES或Metal进行GPU加速;音频处理则涉及降噪、回声消除、增益控制,通过WebRTC或自研算法优化人声清晰度。

推流层:数据上传与网络适配

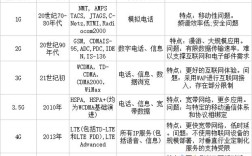

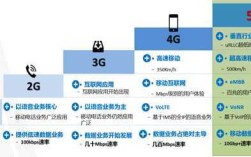

推流层将编码后的音视频数据传输至服务器,是连接终端与核心服务的桥梁,核心挑战在于应对移动网络的不稳定性(如2G/3G/4G/5G/WiFi切换、信号波动)。

- 推流协议:主流采用RTMP(Real-Time Messaging Protocol),因其低延迟(1-3秒)、支持断线重连和加密;部分场景使用HTTP-FLV或SRT(Secure Reliable Transport)以穿透防火墙。

- 网络优化:

- 多线路适配:终端同时通过WiFi和4G双链路推流,服务器端根据丢包率、延迟动态选择最优链路(如主备切换或负载均衡)。

- QoS策略:通过前向纠错(FEC)技术在数据包中添加冗余信息,接收端可修复少量丢包;动态码率调整(ABR)根据实时网络状况调整输出码率,避免卡顿。

- CDN预分发:部分直播场景(如大型活动)支持终端将数据推至就近CDN节点,减少中心服务器压力,提升首屏加载速度。

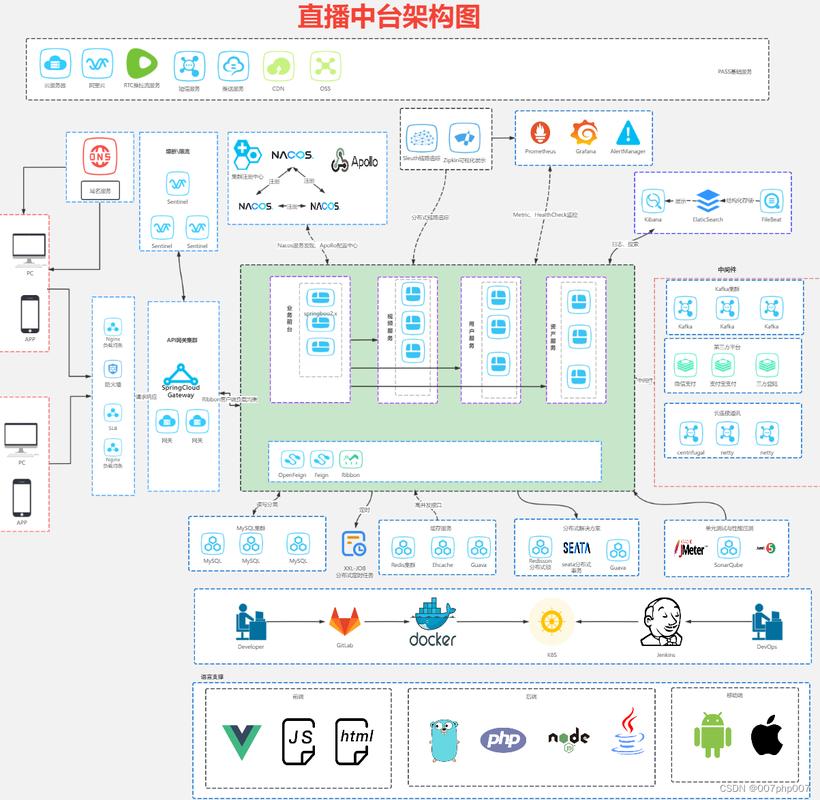

服务层:核心处理与业务逻辑

服务层是直播系统的“大脑”,负责流媒体接入、转码、存储、鉴权及互动功能,需支持高并发和弹性扩展。

- 接入与转码服务:通过Nginx-RTMP、SRS或自研网关接收推流,进行协议转换(如RTMP转HLS/HTTP-FLV)和转码处理,转码集群采用GPU加速(如NVIDIA Tesla),输出多码率、多分辨率的流(如4K/1080p/720p/480p),适配不同终端和网络条件。

- 存储服务:直播录像或回放功能依赖分布式存储(如Ceph、MinIO),采用分片存储(如每10秒一个分片)和冗余备份(3副本),确保数据可靠性。

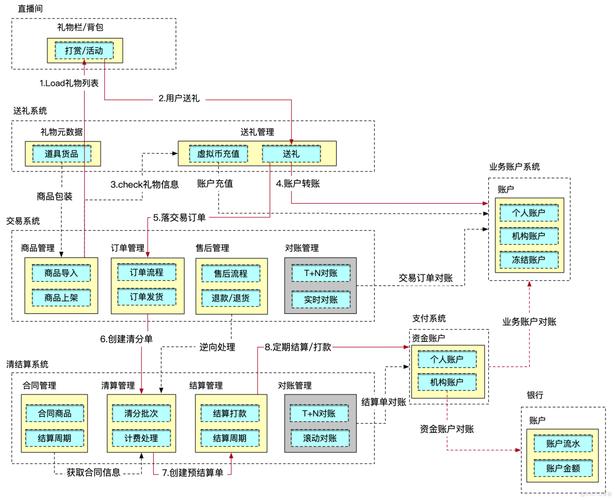

- 互动服务:包括实时聊天(基于WebSocket或长连接)、弹幕、礼物、连麦等功能,连麦需通过SFU(Selective Forwarding Unit)架构转发音视频流,避免终端间P2P连接的复杂性,支持多路混音和画面合成(如画中画)。

- 鉴权与风控:通过OAuth 2.0或JWT进行用户身份验证;结合AI内容审核(如图像识别、文本过滤)和实时弹幕关键词拦截,违规内容触发断流或静默处理。

分发层:内容加速与边缘覆盖

分发层通过CDN(Content Delivery Network)将直播内容推送给全球用户,是降低延迟、提升观看体验的关键。

- 节点架构:采用“中心-边缘”两级节点,中心节点(Origin)负责源站流处理,边缘节点(Edge)部署在全球各地(如运营商机房、IDC机房),用户就近访问边缘节点。

- 调度策略:基于DNS调度(如GTM)或调度算法(如基于延迟、丢包率、负载的加权轮询),将用户指向最优边缘节点;支持HTTPDNS避免传统DNS劫持和解析延迟。

- 协议优化:边缘节点支持HLS(HTTP Live Streaming)和低延迟HLS(LL-HLS),通过分片(TS/M3U8)和增量加载实现秒级延迟(<3秒);部分场景使用WebRTC实现超低延迟(<500ms),适用于连麦、互动直播等场景。

播放层:终端适配与体验优化

播放层负责在用户终端解码并呈现直播内容,需适配不同操作系统、屏幕尺寸和网络环境。

- 播放器组件:iOS端使用AVPlayer,Android端使用ExoPlayer或MediaPlayer,支持硬解码以降低功耗;Web端通过HLS.js或Video.js实现跨平台兼容。

- 弱网优化:播放器支持预加载(提前缓存分片)、缓冲区动态调整(弱网时增大缓冲)、断线重连(自动切换备用CDN节点);通过“秒开”技术(预加载首帧、首屏数据)缩短启动时间。

- 互动体验:支持弹幕实时渲染(基于Canvas或DOM)、礼物动画、画中画播放、倍速播放等功能,结合手势操作(如滑动切换清晰度)提升交互性。

监控与运维体系

保障直播稳定运行需完善的监控和运维支持:

- 实时监控:通过Prometheus+Grafana监控服务器负载、CDN命中率、推流/播放成功率、延迟、丢包率等指标;ELK(Elasticsearch+Logstash+Kibana)收集日志,实时定位故障(如推流中断、卡顿)。

- 容灾与扩缩容:核心服务(如转码、接入)采用多可用区部署,避免单点故障;基于Kubernetes实现容器化扩缩容,应对直播高峰(如秒杀活动、体育赛事)的流量洪峰。

相关问答FAQs

Q1:移动直播中如何解决弱网环境下的卡顿问题?

A:弱网卡顿需从终端、网络、服务三端协同优化:终端侧通过动态码率调整(降低分辨率/帧率)、FEC纠错、双链路推流;网络侧采用TCP/UDP优化(如QUIC协议减少握手延迟)、CDN智能调度;服务侧通过多码率自适应、边缘节点缓存和预分发,结合播放器端的缓冲区动态调整和断线重连,综合提升弱网下的流畅度。

Q2:移动直播的延迟优化有哪些关键技术?

A:低延迟直播依赖协议优化和架构升级:协议上从传统RTMP(3-5秒)升级为SRT(<1秒)、WebRTC(<500ms)或LL-HLS(<3秒);架构上采用SFU替代MCU,减少转码延迟;边缘计算将转码、调度下沉至CDN节点,减少回源路径;终端侧通过预加载、首帧优化和硬件解码,进一步降低播放延迟。