VR(虚拟现实)和AR(增强现实)技术的快速发展离不开一系列底层支撑技术的协同作用,这些技术共同构建了沉浸式体验的核心框架,从硬件感知到软件渲染,再到数据交互,形成了完整的技术生态,以下从关键技术维度展开分析。

硬件感知与显示技术

硬件层是VR/AR体验的基础,核心在于精准捕捉用户动作与环境信息,并实现高质量的视觉呈现。

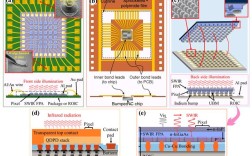

- 显示技术:VR依赖头显设备,主流方案包括基于LCD/OLED的屏显技术和Micro-OLED/Micro-LED等微显示技术,后者凭借高分辨率(单眼4K以上)、低延迟特性成为未来趋势;AR则采用光学透视(如Birdbath、光波导)方案,通过半反半透镜将虚拟信息叠加于现实场景,其中光波导技术(如衍射式、反射式)是实现轻量化AR眼镜的关键。

- 传感器技术:IMU(惯性测量单元)融合陀螺仪、加速度计与磁力计,实时追踪头部六自由度(6DoF)运动;SLAM(同步定位与地图构建)技术通过摄像头、激光雷达(LiDAR)或ToF(飞行时间传感器)获取环境深度信息,实现空间定位与障碍物识别,例如苹果Vision Pro的LiDAR模块可将定位精度厘米级。

图形渲染与交互技术

沉浸式体验的流畅度与真实感依赖于高效的图形处理与自然交互。

- 渲染技术:传统实时渲染依赖GPU硬件加速,但VR/AR需满足90Hz以上高帧率以避免眩晕。注视点渲染(Foveated Rendering)通过眼动追踪仅渲染中央清晰区域,降低50%以上算力消耗;云渲染则将复杂计算转移至云端,通过5G/6G网络低延迟传输画面,支持轻量化终端设备。

- 交互技术:手势识别(如Leap Motion)通过计算机视觉捕捉手部动作;触觉反馈(如Teslasuit的电极触觉、HaptX手套的振动反馈)模拟力感与纹理;眼动追踪(Tobii技术)不仅用于渲染优化,还能实现视线交互,提升操作自然度。

空间计算与人工智能技术

空间计算是VR/AR理解并融合虚实环境的核心,AI则赋予系统智能决策能力。

- 空间计算:6DoF追踪结合传感器数据与SLAM算法,构建三维空间坐标系;空间锚定技术(如ARKit的World Anchors)确保虚拟物体在真实环境中稳定放置,即使设备移动也能保持位置一致。

- 人工智能:计算机视觉(如OpenCV)实现环境识别与物体分割;自然语言处理(如GPT模型)支持语音交互与虚拟助手;机器学习算法优化SLAM精度,减少动态环境下的定位漂移,例如通过神经网络预测用户行为路径。

网络与边缘计算技术

高带宽、低延迟的网络是支撑多人协同与云端渲染的基础。

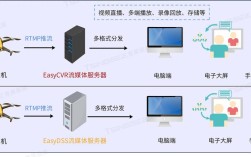

- 5G/6G技术:提供峰值10Gbps以上的传输速率和1ms级低延迟,支持云端渲染、多用户VR社交(如VRChat)等场景;边缘计算将计算任务下沉至基站或本地服务器,减少数据传输距离,保障实时交互的流畅性。

- 数据压缩:VR/AR视频需高效压缩以降低带宽占用,AVS3、VP9等编码标准结合AI超分辨率技术,在有限带宽下提升画面质量。

关键技术对比与应用场景

| 技术类别 | 关键技术 | 核心作用 | 典型应用场景 |

|---|---|---|---|

| 硬件显示 | Micro-OLED、光波导 | 高清视觉呈现、虚实融合 | AR工业维修、VR培训模拟 |

| 空间感知 | SLAM、LiDAR、眼动追踪 | 环境定位、交互捕捉 | AR导航、VR虚拟社交 |

| 图形渲染 | 注视点渲染、云渲染 | 降低算力消耗、提升帧率 | 云端VR游戏、轻量化AR终端 |

| 人工智能 | 计算机视觉、自然语言处理 | 环境理解、智能交互 | AR实时翻译、VR虚拟客服 |

相关问答FAQs

Q1:VR/AR设备为何会产生眩晕感?如何通过技术优化?

A:眩晕主要源于视觉与本体感觉冲突(如画面延迟导致运动感知不一致)、低帧率(<90Hz)或瞳距调节不当,技术优化包括:采用90Hz/120Hz高刷新率屏幕;通过注视点渲染降低渲染负载;优化IMU算法减少运动追踪延迟;结合眼动追踪调整瞳距,提升视觉舒适度。

Q2:光波导技术在AR眼镜中的优势与挑战是什么?

A:优势在于实现“透明化”显示,避免传统棱片方案导致的视野畸变与光损,同时支持轻薄化设计(如Ray-Ban Meta眼镜),挑战在于衍射效率低(lt;50%)、成本高(单模组成本超100美元)以及色散问题影响色彩还原,未来通过纳米压印、全息光栅等技术有望提升性能并降低成本。