谷歌ARCore技术是谷歌推出的增强现实(AR)平台,旨在为移动设备提供强大的AR功能支持,该技术通过整合设备的传感器、摄像头和处理器,实现虚拟物体与真实世界的无缝融合,为开发者构建沉浸式AR体验提供了完整的工具链,ARCore的核心功能包括运动追踪、环境理解和光照估计,这三者协同工作,确保虚拟对象能够稳定地叠加在真实环境中,并自然地与用户互动。

运动追踪是ARCore的基础技术,它利用设备的IMU(惯性测量单元)和摄像头,实时计算设备的位置和方向变化,通过视觉惯性里程计(VIO)算法,ARCore能够持续追踪设备的6自由度运动,即使在部分纹理缺失或快速移动的情况下也能保持稳定性,当用户手持手机在房间中走动时,虚拟物体能够始终保持在正确的位置,不会因为设备晃动而出现偏移。

环境理解功能让ARCore能够识别真实世界的平面、边界和物体表面,通过深度学习和计算机视觉技术,ARCore可以检测水平面(如地面、桌面)和垂直面(如墙壁),并估算这些平面的尺寸和形状,开发者可以利用这些信息,让虚拟物体“放置”在真实平面上,如将虚拟家具模型放在房间中,或让虚拟角色站在桌面上,ARCore还支持边界检测,帮助用户定义AR交互的物理范围,提升体验的真实感。

光照估计技术则确保虚拟物体能够与真实环境的光照条件一致,ARCore通过分析环境中的光线强度和颜色,动态调整虚拟对象的材质和阴影效果,使其看起来更自然,当用户将手机从明亮处移到阴影中时,虚拟物体的亮度和阴影会相应变化,增强沉浸感,这一功能对于需要高度真实感的AR应用至关重要,如室内设计或虚拟试穿。

ARCore支持多种开发平台,包括Unity、Unreal Engine和Android原生开发,开发者可以根据需求选择合适的工具链,在Unity中,ARCore SDK提供了丰富的组件和脚本,简化了AR功能的集成;在原生开发中,ARCore API允许开发者直接调用底层功能,实现高度定制化的体验,ARCore与谷歌的AR生态系统深度整合,如与Google Lens的联动,可以实时识别物体并叠加相关信息,进一步拓展了AR的应用场景。

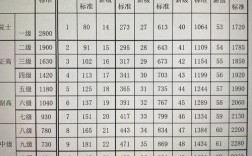

ARCore技术的应用领域广泛,涵盖了教育、零售、娱乐、工业等多个行业,在教育领域,ARCore可以将抽象的3D模型(如人体器官、太阳系)投射到真实场景中,帮助学生直观理解复杂概念;在零售领域,用户可以通过AR“试穿”衣物或“预览”家具在家中的摆放效果;在工业领域,ARCore可用于设备维护指导,通过叠加虚拟操作步骤,帮助技术人员快速解决问题,以下表格总结了ARCore的核心功能及其应用场景:

| 核心功能 | 技术原理 | 应用场景示例 |

|---|---|---|

| 运动追踪 | 视觉惯性里程计(VIO) | 虚拟物体稳定跟随设备移动 |

| 环境理解 | 平面检测与边界识别 | 虚拟家具放置、游戏场景搭建 |

| 光照估计 | 环境光分析算法 | 虚拟物体阴影与光照自然融合 |

| 深度感知 | 单目深度估计与机器学习 | 避免虚拟物体穿透真实表面 |

尽管ARCore功能强大,但仍面临一些挑战,如设备兼容性限制(需支持ARCore的Android设备)、低光环境下的性能下降,以及复杂纹理场景的平面检测精度问题,为此,谷歌持续优化算法,并通过ARCore XR Extensions支持更多AR硬件(如AR眼镜),推动AR技术的普及。

相关问答FAQs:

-

问:ARCore与苹果ARKit有什么区别?

答:ARCore和ARKit分别是谷歌和苹果的AR平台,主要区别在于底层硬件适配和生态系统,ARCore主要支持Android设备,依赖谷歌服务框架;ARKit专为iOS设备优化,与苹果硬件深度集成,两者在核心功能(如运动追踪、平面检测)上相似,但API设计和开发工具链不同,开发者需根据目标平台选择合适的技术。 (图片来源网络,侵删)

(图片来源网络,侵删) -

问:普通用户如何体验基于ARCore的应用?

答:普通用户只需拥有一台支持ARCore的Android设备(如Pixel、三星旗舰机型),在Google Play商店下载AR应用(如Google Arts & Culture、IKEA Place),打开应用并授权摄像头权限即可体验,部分应用可能需要用户在真实空间中移动设备,以便ARCore扫描环境并初始化AR场景。