语音增强技术与自然语言处理(NLP)的融合是近年来人工智能领域的重要发展方向,这种跨模态的结合不仅拓展了语音技术的应用边界,也为NLP系统在复杂真实场景下的性能提升提供了新的路径,语音增强技术最初专注于解决语音信号中的噪声干扰、混响、多人说话重叠等问题,通过信号处理算法(如谱减法、维纳滤波、深度学习方法等)提取纯净语音,其核心目标是提升语音的清晰度和可懂度,而NLP则聚焦于文本的理解、生成与交互,依赖高质量的文本输入作为基础,随着技术的发展,语音与文本的界限逐渐模糊,语音增强技术从单纯的“信号净化”向“语义级优化”演进,与NLP的结合点也从简单的语音转文本(ASR)预处理,扩展到语义理解、情感分析、多模态交互等多个层面。

从技术流程来看,语音增强与NLP的融合主要体现在三个阶段,首先是输入端增强,传统ASR系统对噪声环境下的语音识别率较低,语音增强技术通过降噪、去混响等预处理,为ASR提供更纯净的语音信号,从而提升文本转录的准确率,在会议场景中,针对多人混叠语音的分离技术(如基于深度聚类的方法)可以分离不同说话人的语音,再分别输入ASR系统,避免说话人混淆导致的识别错误,其次是语义级增强,随着端到端模型的发展,语音增强不再局限于信号层面的优化,而是开始融入语义信息,利用NLP中的上下文理解能力,模型可以识别当前语音片段的语义主题,从而针对性地抑制与主题无关的噪声(如背景音乐、无关人声),甚至根据语义内容调整增强策略——在关键信息(如人名、数字、指令)出现时增强语音保真度,在冗余信息出现时适当降低处理复杂度,以平衡性能与效率,最后是输出端优化,语音增强后的语音信号可能仍存在残留噪声或失真,此时可通过NLP技术对转录文本进行后处理,例如基于上下文的纠错(修正因语音失真导致的ASR错误)、语义连贯性优化(调整语序补充缺失信息)等,形成“语音增强-ASR-NLP后处理”的完整闭环。

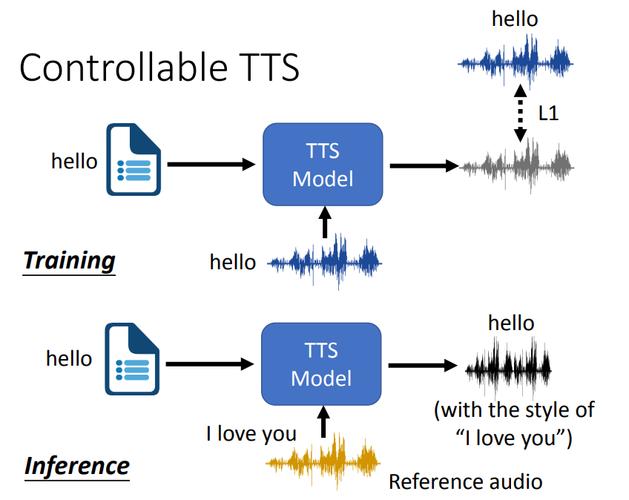

技术实现层面,两者的融合依赖深度学习模型的跨模态特征提取与协同优化,传统语音增强多使用循环神经网络(RNN)或卷积神经网络(CNN)处理语音信号的时频特征,而与NLP结合后,Transformer架构成为主流,其自注意力机制能够同时捕捉语音序列中的长时依赖和文本语义关联,在“语音-文本联合增强”模型中,语音分支通过梅尔频谱图输入Transformer提取声学特征,文本分支通过词嵌入向量提取语义特征,两个分支通过跨模态注意力层进行信息交互,使模型在增强语音信号时能够参考文本语义(如根据关键词调整增强强度),或在生成文本时修正语音信号的歧义,多任务学习框架也被广泛应用,例如将语音增强、说话人识别、情感分析与ASR任务联合训练,模型在提升语音质量的同时,自动提取说话人身份、情感倾向等高维特征,这些特征可作为NLP理解上下文的辅助信息,增强对话系统的交互能力。

应用场景上,语音增强与NLP的融合已覆盖智能助手、会议系统、医疗听写、车载语音等多个领域,在智能助手场景中,结合语音增强的NLP系统能在嘈杂环境中准确识别用户指令,并通过语义理解过滤无关噪声,提升响应准确性;在远程会议中,语音分离与增强技术可实现“人声分离+ASR转写+NLP摘要生成”的一体化流程,自动生成会议纪要并标记关键发言;在医疗听写领域,针对专业术语多、环境噪声复杂的场景,语音增强可消除设备干扰和背景杂音,NLP则通过医疗术语库优化转录文本,确保病历记录的准确性,在车载语音交互中,结合语音增强的NLP系统可区分驾驶员指令与乘客对话,抑制发动机噪声和音乐干扰,实现更安全的语音控制。

尽管技术进展显著,语音增强与NLP的融合仍面临挑战,语音信号的噪声类型复杂多变(突发噪声、稳态噪声、非平稳噪声等),且与语义信息的关联难以精确建模,导致增强策略的泛化能力受限;跨模态模型计算复杂度高,实时性要求高的场景(如实时翻译、语音助手)需平衡模型性能与推理速度,轻量化模型设计(如知识蒸馏、模型压缩)、多模态预训练(如语音-文本联合预训练模型)、以及个性化增强(根据用户语音习惯和场景动态调整参数)将成为重要研究方向。

相关问答FAQs

Q1:语音增强技术如何提升NLP系统的鲁棒性?

A1:语音增强技术通过解决语音信号中的噪声、混响、多人混叠等问题,为NLP系统提供更高质量的文本输入,从而提升其鲁棒性,在嘈杂环境中,增强后的语音信号能显著降低ASR的识别错误率,减少NLP文本理解的歧义;结合语义信息的增强策略可过滤与任务无关的噪声,使NLP模型更聚焦于有效内容,避免因语音质量问题导致的语义偏差,语音增强提取的声学特征(如说话人身份、情感倾向)可作为NLP的辅助输入,增强其对上下文的理解能力。

Q2:语音增强与NLP融合面临的主要技术挑战有哪些?

A2:主要挑战包括:①噪声与语义的关联建模难度大,不同场景下噪声类型与语义内容的交互复杂,难以设计统一的增强策略;②跨模态模型计算复杂度高,实时场景下需平衡性能与效率;③数据依赖性强,高质量“语音-文本-语义”标注数据稀缺,影响模型泛化能力;④个性化需求与通用模型的矛盾,不同用户的语音习惯、环境噪声差异大,通用模型难以适配所有场景,未来需通过轻量化设计、多模态预训练、动态自适应算法等方向突破这些瓶颈。