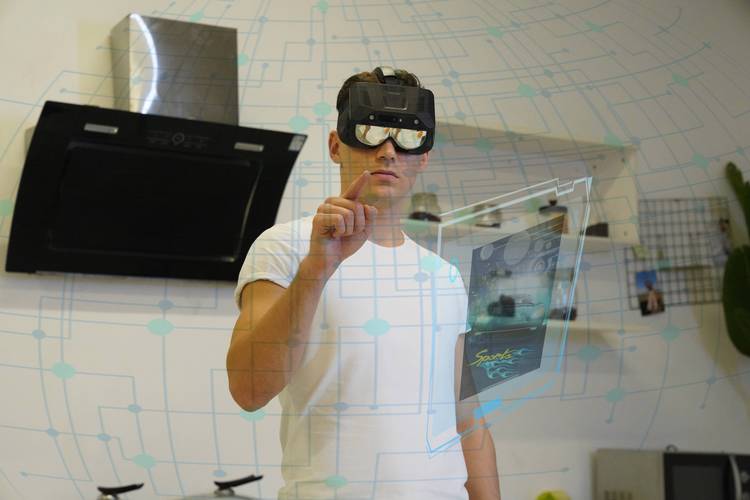

ar物体模拟移动技术是一种通过增强现实(AR)系统在真实环境中虚拟呈现物体并实现其动态移动交互的技术,其核心在于将虚拟物体与现实场景进行精准的空间对齐,并通过实时计算与渲染,让用户能够直观地观察、操控虚拟物体在三维空间中的运动轨迹与状态,这项技术融合了计算机视觉、空间定位、实时渲染、人机交互等多学科技术,是AR领域实现虚实融合交互的关键支撑,近年来在工业设计、教育培训、医疗手术、零售展示、娱乐游戏等场景中展现出广泛的应用潜力。

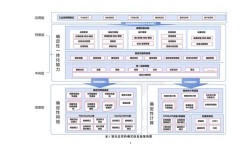

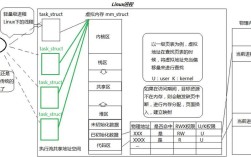

从技术实现层面来看,ar物体模拟移动技术的流程可分为空间感知、虚拟物体注册、运动模拟与交互反馈四个核心环节,空间感知环节依赖设备的传感器(如摄像头、IMU、LiDAR等)采集环境数据,通过SLAM(同步定位与地图构建)技术实时构建三维环境模型,同时确定设备在空间中的位置与姿态,这是虚拟物体与现实场景融合的基础,虚拟物体注册环节则需将虚拟物体精确映射到现实空间的对应位置,涉及坐标系转换、空间锚点锁定等技术,确保虚拟物体不会因设备移动而出现位置漂移或尺度失真,运动模拟环节是技术实现的重点,需根据用户输入或预设算法计算虚拟物体的运动轨迹,包括平移、旋转、缩放等基本变换,以及更复杂的物理运动模拟(如重力、碰撞、弹性形变等),这一环节依赖物理引擎与实时渲染引擎的协同工作,以保障运动的流畅性与真实感,交互反馈环节则通过手势识别、语音控制、触控设备等方式接收用户操作指令,并将虚拟物体的运动状态实时反馈给用户,形成完整的交互闭环。

在关键技术模块中,空间定位与跟踪技术的精度直接决定虚拟物体移动的稳定性,当前主流的定位方案包括基于视觉的V-SLAM(视觉SLAM)、基于激光雷达的L-SLAM,以及融合多传感器数据的紧耦合SLAM方案,苹果的ARKit与谷歌的ARCore均采用相机IMU数据融合的SLAM算法,结合特征点检测与光流法实现亚毫米级的空间定位,确保虚拟物体在设备移动过程中保持稳定附着,实时渲染技术则负责将虚拟物体的运动状态以高帧率、低延迟的方式呈现给用户,移动端多采用基于OpenGL ES或Metal的延迟渲染技术,结合LOD(细节层次)模型优化与动态遮挡处理,平衡渲染质量与性能需求;而高端AR设备(如HoloLens)则采用全息光场渲染技术,实现不同视角下的裸眼3D视觉效果,进一步提升运动模拟的真实感。

物理模拟引擎是提升虚拟物体运动真实性的核心组件,通过建立数学模型模拟真实世界的物理规律,常见的物理引擎如Bullet、PhysX等,提供了刚体动力学、软体变形、流体模拟、碰撞检测与响应等功能,在工业AR场景中,模拟机械零件的装配过程时,物理引擎可计算零件之间的碰撞力、摩擦力与重力影响,使虚拟零件的运动轨迹更接近真实物理行为,避免出现“穿模”等不真实现象,基于深度学习的运动预测技术也逐渐被引入,通过分析历史运动数据与用户操作习惯,预测虚拟物体的下一步运动状态,减少计算延迟,提升交互的流畅性。

人机交互技术的发展则推动了虚拟物体操控方式的多样化,早期的AR交互多依赖触屏或简单的手势识别,而如今,基于计算机视觉的手势识别技术(如MediaPipe)已能实现指尖追踪、手势分割与动作分类,支持用户通过抓取、旋转、滑动等自然手势操控虚拟物体;眼动追踪技术(如Tobii Eye Tracker)可结合视线焦点与凝视时间实现物体的选中与缩放,提升交互效率;语音交互则通过自然语言处理技术将用户指令转化为物体运动参数,适合在需要解放双手的场景(如手术模拟、工业维修)中应用,多模态交互技术的融合,进一步增强了用户对虚拟物体运动的控制精度与自然感。

ar物体模拟移动技术的应用场景已渗透到多个行业,在工业设计与制造领域,工程师可通过AR技术将虚拟三维模型叠加到真实生产线中,模拟零件的装配路径、机械臂的运动轨迹,提前发现设计缺陷,减少物理样机成本;教育培训中,学生可通过AR操控虚拟生物模型观察其细胞分裂过程,或拆解虚拟发动机了解内部结构,实现抽象知识的具象化学习;医疗手术中,医生可基于患者CT/MRI数据构建三维器官模型,在AR环境中模拟手术器械的移动路径与切割深度,规划精准手术方案;零售与电商领域,消费者可通过AR技术将虚拟家具“摆放”到家中,观察尺寸匹配度与风格协调性,或试穿虚拟服装,提升购物体验;娱乐游戏领域,虚拟物体的移动模拟则构建了沉浸式的游戏场景,如通过手势控制虚拟魔法球的飞行轨迹,或模拟物理碰撞效果的游戏关卡设计。

尽管应用前景广阔,ar物体模拟移动技术仍面临多项技术挑战,首先是环境适应性问题,复杂光照条件(如强光、弱光)、纹理缺失表面(如白墙、玻璃)可能导致SLAM定位精度下降,引发虚拟物体移动抖动或漂移;其次是计算性能瓶颈,高精度物理模拟与实时渲染对设备算力要求较高,移动端易出现发热、卡顿现象,影响用户体验;长时间交互下的用户疲劳问题也亟待解决,例如虚拟物体运动延迟、视觉与感官冲突(如运动视差不匹配)可能导致用户眩晕,针对这些问题,未来技术发展将聚焦于轻量化SLAM算法(如基于神经网络的场景理解)、边缘计算与云端渲染协同架构(如5G+AR)、以及符合人因工程的交互设计(如自适应运动参数调节)等方面。

相关问答FAQs:

Q1:ar物体模拟移动技术与传统3D动画中的物体运动有何本质区别?

A1:两者核心区别在于交互性与环境融合度,传统3D动画中的物体运动是预设的、非交互的,用户只能被动观看固定轨迹的运动;而ar物体模拟移动技术强调实时交互,用户可通过手势、语音等方式直接操控虚拟物体的运动参数,且虚拟运动需与真实环境进行空间对齐(如避开现实障碍物、受真实物理规律约束),实现“虚实融合”的动态效果,而非单纯的虚拟场景展示。

Q2:当前消费级AR设备(如手机、AR眼镜)在实现物体模拟移动时存在哪些主要局限?

A2:主要局限包括三方面:一是空间定位精度不足,尤其在动态环境中(如手持设备快速移动时),易出现虚拟物体位置漂移;二是物理模拟简化,受限于设备算力,复杂物理效果(如流体、软体变形)难以实时计算,多采用简化模型导致真实感降低;三是交互延迟,从用户操作到虚拟物体响应存在时间差(通常低于100ms为佳,但当前部分设备可达150-200ms),影响操控体验,消费级AR设备的视场角(FOV)普遍较小(手机AR约30°-40°,眼镜AR约40°-60°),也限制了虚拟物体运动范围的可视化效果。