Hadoop生态圈技术是一套围绕Hadoop核心组件构建的开源大数据处理框架,旨在解决海量数据的存储、计算、分析和管理问题,随着数据规模的爆炸式增长,传统的关系型数据库和单机计算工具已无法满足需求,Hadoop生态圈通过分布式存储、并行计算和资源管理等核心技术,为企业提供了从数据采集到数据价值挖掘的全流程解决方案,以下从核心组件、技术特点、应用场景及发展趋势等方面详细阐述Hadoop生态圈技术。

Hadoop生态圈的核心是Hadoop Distributed File System(HDFS)和MapReduce,HDFS作为分布式文件系统,将大文件切分成多个块(默认128MB),存储在多个DataNode节点上,通过NameNode统一管理文件元数据,实现了高容错性和高吞吐量,MapReduce则是分布式计算模型,将任务分解为Map和Reduce两个阶段,Map阶段负责处理数据分片并输出中间结果,Reduce阶段对中间结果进行聚合,最终得到计算结果,尽管MapReduce在处理复杂计算时存在延迟较高的问题,但其分而治之的思想为后续分布式计算框架奠定了基础。

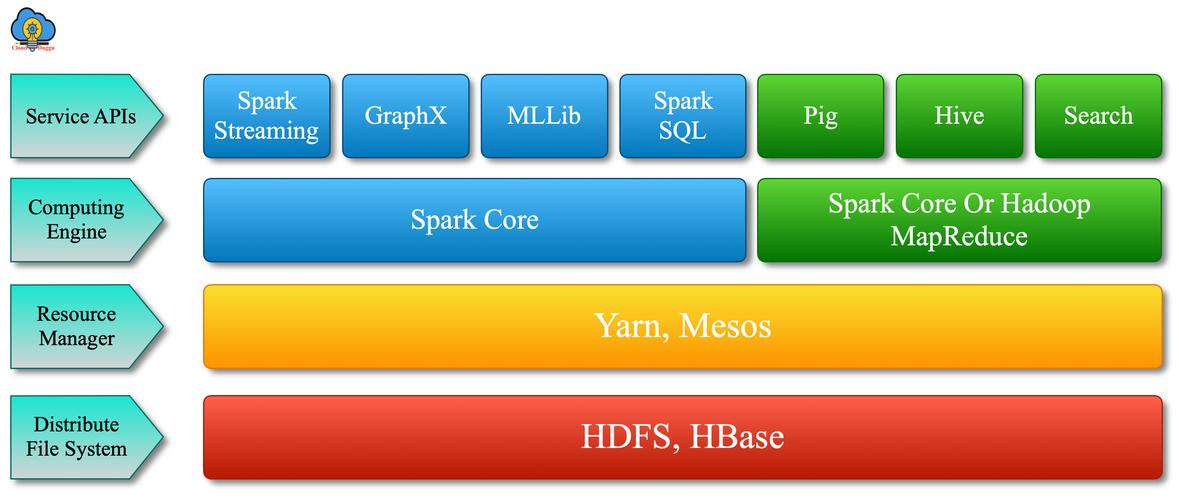

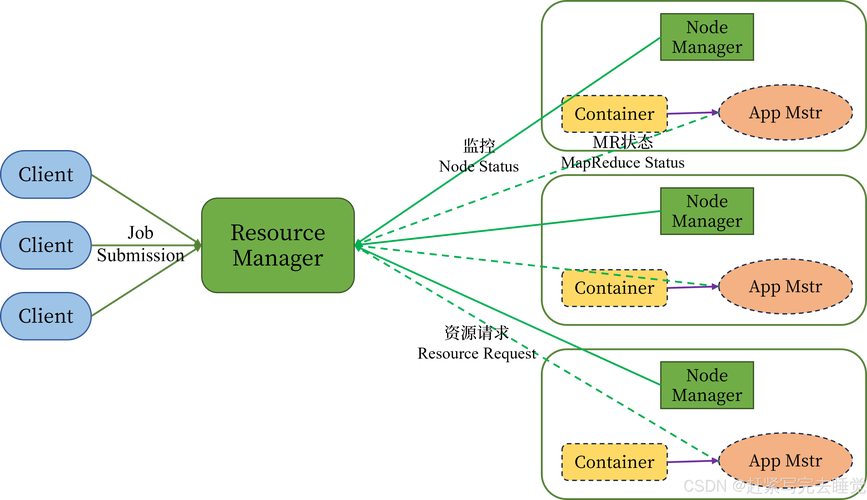

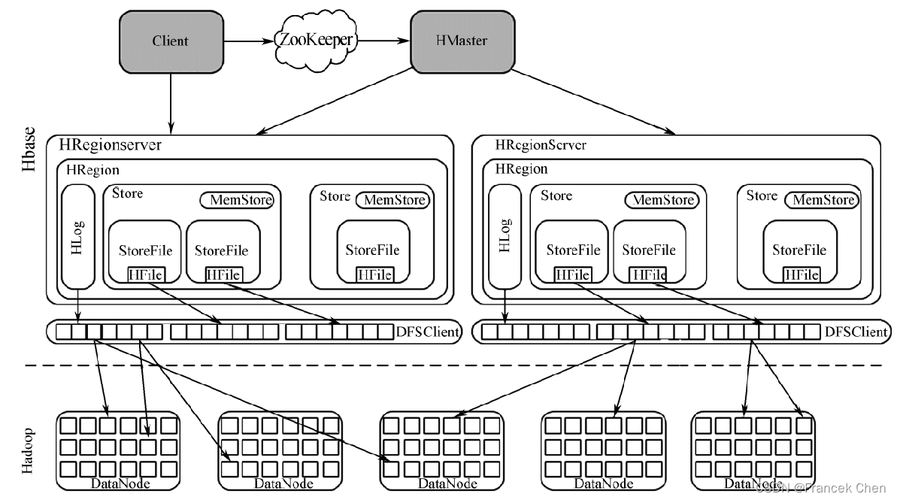

在Hadoop生态圈中,YARN(Yet Another Resource Negotiator)的引入标志着资源管理的重要突破,YARN作为资源管理器,负责集群资源的统一调度和任务监控,支持MapReduce、Spark、Flink等多种计算框架运行在同一个集群上,提高了集群资源的利用率,生态圈中涌现出大量组件,弥补了Hadoop在实时计算、数据仓库、机器学习等领域的不足,HBase作为分布式NoSQL数据库,基于HDFS提供高随机读写性能,适用于海量数据的实时查询;Hive通过类SQL语言(HQL)将查询转换为MapReduce或Tez任务,实现了数据仓库的构建;Spark作为内存计算框架,通过DAG调度和内存缓存机制,显著提升了迭代计算和流式处理的效率;Kafka作为分布式消息队列,支持高吞吐量的数据采集和传输,成为实时数据管道的核心组件。

Hadoop生态圈的技术特点主要体现在以下几个方面:一是高扩展性,通过增加节点即可线性扩展存储和计算能力,适用于PB级甚至EB级数据的处理;二是高容错性,数据块多副本存储和任务失败重试机制确保了系统的可靠性;三是成本效益,基于普通商用硬件构建集群,降低了企业硬件投入成本;四是灵活性,支持批处理、流处理、交互式查询等多种计算模式,满足不同业务场景需求,生态圈组件之间的协同工作形成了完整的数据处理流水线,例如Flume采集日志数据存储到HDFS,通过Hive进行数据清洗和分析,利用Spark进行机器学习建模,最终通过Tableau或Superset实现数据可视化。

从应用场景来看,Hadoop生态圈广泛应用于互联网、金融、电信、零售等行业,在互联网领域,Hadoop用于用户行为分析、推荐系统和日志处理;在金融行业,支持风险控制、反欺诈和交易数据分析;在电信行业,实现网络流量监控和用户画像构建;在零售行业,助力销售预测、库存管理和精准营销,某电商平台通过Hadoop生态圈处理每日产生的TB级用户行为数据,利用Spark MLlib构建推荐模型,将商品推荐准确率提升30%;某银行通过Hadoop和Flink实时分析交易数据,将欺诈交易的识别时间从小时级缩短至秒级。

尽管Hadoop生态圈在大数据领域占据重要地位,但也面临一些挑战,随着实时计算需求的增长,MapReduce的批处理特性逐渐被Spark、Flink等框架替代;数据安全和隐私保护问题日益突出,需要结合Kerberos、Ranger等技术加强权限管理;多集群管理和资源调度复杂性增加,Mesos和Kubernetes等容器化技术逐渐融入生态圈,Hadoop生态圈将与云原生技术深度融合,支持Serverless计算和多云部署,同时通过AI与大数据的结合,提升数据智能分析能力,生态圈组件将进一步优化性能,例如HDFS支持小文件合并,Spark增强对GPU加速的支持,以适应更广泛的应用场景。

相关问答FAQs

Q1:Hadoop生态圈中的Spark与MapReduce有何本质区别?

A1:Spark与MapReduce的核心区别在于计算模型和执行效率,MapReduce基于磁盘计算,中间结果需要写入HDFS,导致I/O开销大,适合批处理任务;而Spark基于内存计算,通过RDD(弹性分布式数据集)和DAG调度机制,将中间数据缓存在内存中,大幅减少磁盘I/O,支持迭代计算、流处理和机器学习等复杂场景,Spark的API更丰富,支持Scala、Java、Python等多种语言,开发效率更高。

Q2:如何选择Hadoop生态圈中的组件进行实时数据处理?

A2:实时数据处理需根据延迟要求和数据特点选择合适组件,对于低延迟(毫秒级)场景,可采用Kafka+Flink组合,Kafka作为数据缓冲,Flink进行实时计算;对于中低延迟(秒级)场景,可选择Kafka+Spark Streaming,利用Spark的微批处理机制;若需结合历史数据分析,可采用Kafka+HBase+Spark,HBase存储历史数据,Spark进行实时与离线数据的联合计算,Storm适用于超高吞吐量但容忍一定延迟的场景,需根据业务需求权衡选择。