在数字化时代,系统的稳定性和可靠性是企业业务连续性的核心保障,高可用技术作为实现这一目标的关键手段,与开源软件的结合已成为现代架构设计的主流选择,高可用技术通过冗余设计、故障转移、负载均衡等策略,确保系统在硬件故障、软件异常或流量高峰等场景下仍能提供持续服务,而开源软件则以其开放性、成本优势和社区支持,为高可用架构提供了丰富的工具和灵活的实现方案。

高可用技术的核心目标与实现路径

高可用技术的核心目标是最大化系统的平均无故障时间(MTTF)并最小化平均修复时间(MTTR),最终实现服务的高连续性,其实现路径主要包括以下几个层面:

- 冗余设计:通过硬件、数据或服务的冗余副本消除单点故障,在服务器层采用多台节点组成集群,避免因单台服务器宕机导致服务中断;在数据层通过主从复制、分布式存储确保数据的多副本保存,防止数据丢失。

- 故障检测与转移:实时监控系统组件的健康状态,一旦发现故障,自动将流量切换到备用节点,通过心跳检测机制(如Keepalived、Pacemaker)判断节点存活状态,结合VIP(虚拟IP)技术实现服务的快速切换。

- 负载均衡:将流量合理分发到多个后端节点,避免单个节点过载,同时提升系统的整体处理能力,常见的负载均衡算法包括轮询、加权轮询、最少连接数等,工具如Nginx、HAProxy、LVS等开源软件可灵活实现这些策略。

- 容灾与备份:在异地部署冗余中心,通过数据同步技术(如异步复制、同步复制)确保主备中心数据一致,当发生区域性灾难时,可快速切换至异地中心恢复服务。

开源软件在高可用架构中的实践

开源软件凭借其透明性、可定制性和低成本优势,成为构建高可用架构的首选工具,以下从不同技术维度分析开源软件的应用:

负载均衡与反向代理

- Nginx:作为高性能的HTTP服务器和反向代理,Nginx通过

upstream模块实现后端服务器的负载均衡,支持健康检查和故障节点的自动剔除,配合keepalive_timeout和proxy_next_upstream等参数优化故障转移效率。 - HAProxy:专注于TCP/HTTP负载均衡,支持基于ACL(访问控制列表)的复杂路由规则,其内置的健康检查机制可实时监测后端服务状态,并通过

frontend/backend配置灵活管理流量分发。 - LVS(Linux Virtual Server):基于Linux内核的虚拟服务器,通过IP负载均衡(NAT)、直接路由(DR)或隧道(TUN)模式实现高性能负载均衡,适用于大规模集群场景。

集群管理与故障转移

- Keepalived:基于VRRP(虚拟路由冗余协议)实现高可用,通过虚拟IP(VIP)的漂移机制确保主备节点的无缝切换,常与Nginx、HAProxy等组件结合,形成“负载均衡+故障转移”的高可用方案。

- Pacemaker:开源的集群资源管理器,支持复杂的服务依赖关系和故障恢复策略,可通过Corosync实现节点间通信,管理数据库(如MySQL、PostgreSQL)、Web服务等资源的集群化部署。

- etcd:高可用的键值存储系统,用于服务发现和配置共享,其Raft一致性算法确保数据在多个节点间的强一致性,是Kubernetes集群的核心组件之一。

数据高可用与存储

- MySQL主从复制:通过binlog日志实现主数据库到从数据库的数据同步,结合MHA(Master High Availability)工具可实现主节点的自动故障检测和切换,确保数据库服务的高可用。

- Redis Sentinel:提供Redis实例的监控、故障报警和自动故障转移,当主节点宕机时,Sentinel集群会选举新的主节点并更新配置,确保缓存服务的连续性。

- Ceph:开源的分布式存储系统,通过CRUSH算法实现数据分布和副本管理,支持对象存储、块存储和文件存储,具备高扩展性和数据容错能力。

容灾与多云管理

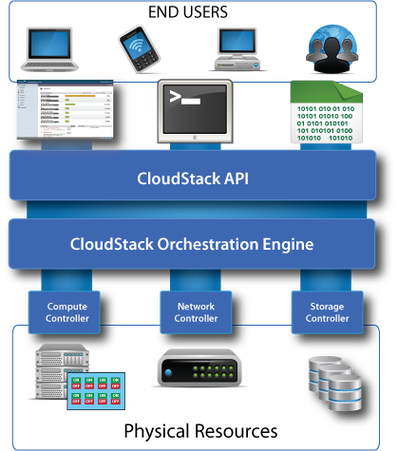

- OpenStack:开源的云计算管理平台,其Zaqar消息队列和Barbican密钥管理服务可构建跨云环境的高可用架构,支持虚拟机、存储等资源的动态迁移和故障恢复。

- Prometheus + Grafana:Prometheus负责监控系统的各项指标,Grafana提供可视化展示,结合Alertmanager实现故障报警,帮助运维人员及时发现并处理问题,预防故障发生。

高可用技术与开源软件的协同优势

高可用技术与开源软件的结合,不仅降低了企业的IT成本,还通过社区的持续迭代提升了系统的可靠性和灵活性,开源软件的开放性允许企业根据业务需求定制功能,而高可用技术则为开源软件的落地提供了实践框架,二者相辅相成,在Kubernetes集群中,通过etcd实现服务发现,使用Keepalived管理VIP,结合Prometheus监控,可构建一套完整的云原生高可用架构。

相关问答FAQs

Q1:高可用架构中,如何避免“脑裂”问题?

A:“脑裂”是指集群中多个节点同时认为自己是主节点,导致数据冲突或服务异常,避免脑裂的核心措施包括:

- 引入仲裁机制:使用第三方仲裁节点(如Qdevice、Witness)或共享存储,确保只有多数节点达成共识才能进行主节点选举。

- 优化心跳检测:缩短心跳超时时间,避免因网络延迟误判节点故障;采用多心跳路径(如网络、存储心跳)降低单点依赖。

- 使用成熟集群软件:如Pacemaker、Corosync等已内置脑裂防护机制,通过

quorum(法定人数)策略确保集群决策的一致性。

Q2:开源高可用工具(如Keepalived、HAProxy)如何实现自动化故障转移?

A:自动化故障转移的实现依赖以下步骤:

- 健康检查:工具定期向后端节点发送探测请求(如HTTP、TCP ping),若连续多次检测失败,则判定节点故障。

- 状态同步:集群节点间通过组播或单播机制同步状态信息,确保所有节点对当前可用节点达成一致。

- 流量切换:当主节点故障时,备用节点通过接管VIP(如Keepalived的VRRP)或更新负载均衡配置(如HAProxy的

backend服务器状态),将流量导向其他健康节点。 - 故障恢复:原主节点恢复后,可通过手动干预或预设策略(如抢占模式、非抢占模式)决定是否重新接管服务,避免频繁切换导致服务抖动。