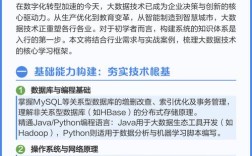

nlp自然语言处理技术是人工智能领域的重要分支,专注于让计算机理解、解释和生成人类语言,其核心目标是架起人类自然语言与计算机处理之间的桥梁,随着深度学习和大模型技术的突破,nlp技术已从早期的基于规则和统计的方法,发展到如今以神经网络为核心的智能阶段,广泛应用于机器翻译、智能客服、情感分析、文本生成、信息检索等多个场景。

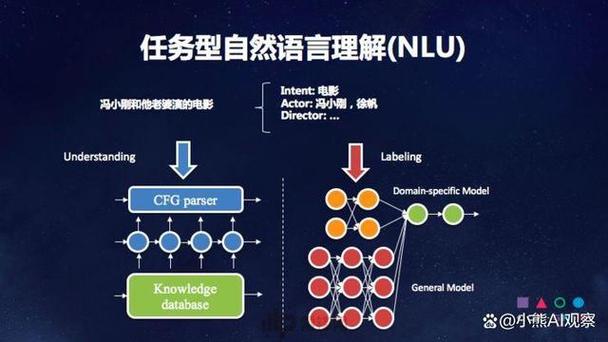

nlp自然语言处理技术的核心任务可分为语言理解与语言生成两大方向,语言理解包括分词、词性标注、命名实体识别、句法分析、语义理解等基础任务,其中分词是中文处理的关键步骤,需将连续文本切分为有意义的词汇单元;命名实体识别则用于识别文本中的人名、地名、机构名等特定信息,语义理解更进一步,通过词向量(如Word2Vec、GloVe)将文本转化为数值化表示,捕捉词语间的语义关系,而预训练语言模型(如BERT、GPT)的出现,通过海量文本数据学习上下文相关的语义表示,极大提升了理解任务的准确性,语言生成则涵盖文本摘要、机器翻译、对话系统、创意写作等,其核心是根据输入信息生成符合语法和语义规则的自然语言文本,近年来大模型技术已能生成连贯、逻辑性强的长文本,甚至具备跨领域创作能力。

技术实现方面,nlp自然语言处理经历了多个发展阶段,早期基于规则的方法依赖语言学专家手工编写规则,泛化能力差;随后统计学习方法(如n-gram、隐马尔可夫模型)通过概率模型处理语言,但仍需人工设计特征,深度学习时代,循环神经网络(RNN)及其变体(LSTM、GRU)解决了序列数据处理问题,Transformer模型凭借自注意力机制实现了并行计算和长距离依赖建模,成为当前主流架构,预训练-微调范式进一步推动了技术进步,模型先在大规模无标注数据上预训练学习通用语言知识,再针对特定任务微调,显著降低了数据标注成本并提升了性能,GPT系列模型通过海量文本预训练,具备了强大的生成能力;而BERT模型则通过双向编码器,在理解类任务中表现优异。

应用场景上,nlp自然语言处理技术已深度融入日常生活和企业运营,在智能客服领域,聊天机器人基于nlp技术理解用户意图并提供自动回复,大幅提升服务效率;机器翻译工具如谷歌翻译、DeepL,通过神经网络模型实现多语言实时互译,准确率接近人工水平;社交媒体平台利用情感分析技术监测用户情绪,辅助舆情分析和产品优化;医疗领域,nlp技术可从电子病历中提取关键信息,辅助疾病诊断和药物研发;教育领域,智能批改系统和个性化学习工具通过分析学生作文和学习数据,提供精准反馈,nlp还在法律文书处理、金融风控、内容创作等领域发挥重要作用,成为数字化转型的核心技术之一。

尽管nlp自然语言处理技术取得了显著进展,但仍面临诸多挑战,如语言歧义性、上下文依赖、小样本学习、多模态融合等问题,随着多模态大模型、低资源语言处理、可解释性AI等方向的发展,nlp技术将更贴近人类认知方式,实现更自然、更智能的人机交互。

相关问答FAQs

-

问:nlp自然语言处理技术与传统文本处理有何区别?

答:传统文本处理多基于规则或简单统计方法,依赖人工设计特征,处理能力有限且泛化性差;nlp技术则深度融合深度学习和大数据,通过神经网络模型自动学习语言特征,能处理复杂语义、上下文语境和长文本,具备更强的理解与生成能力,适用于更广泛的实际场景。 -

问:预训练语言模型(如BERT、GPT)为何能显著提升nlp性能?

答:预训练语言模型通过在大规模无标注文本上学习通用语言知识,捕获了词汇、语法、语义等深层次语言规律,其核心优势在于:①迁移学习能力,将预训练知识迁移到下游任务,减少对标注数据的依赖;②上下文表示能力,动态生成词语的上下文相关向量,解决一词多义等问题;③规模化效应,模型参数和数据量的增加持续提升性能,从而在机器翻译、问答系统等任务中达到接近人类水平的表现。