可以把 Oculus Rift 的技术原理拆解为几个核心部分:头部追踪、立体渲染、透镜显示和空间音频,这些技术协同工作,共同创造出沉浸式的虚拟现实体验。

下面我们逐一进行深入讲解。

核心原理:人眼视觉的模拟

首先要理解,VR 的目标就是欺骗我们的大脑,让它相信自己身处一个虚拟世界中,Oculus Rift 的所有技术都围绕如何完美模拟人眼的自然视觉。

- 立体视觉: 我们之所以能感知到世界的深度和三维结构,是因为我们的两只眼睛相隔一段距离(瞳距),从略微不同的角度观察同一物体,大脑会将这两个略有差异的 2D 图像融合成一个单一的、带有深度感的 3D 图像,Oculus Rift 利用了这一点,为左右两眼分别渲染一张不同的图像,模拟这种“视差”。

- 视野: 人眼的水平视野大约有 200-220 度,但清晰的中心视野(我们用来看东西的部分)只有大约 90-100 度,Oculus Rift 的目标是提供一个足够宽的视野(尤其是水平视野),让你感觉“置身其中”,而不是通过一个窗户看世界,早期版本约为 110 度,后来的 CV1 提升到了约 100 度,虽然不及人眼极限,但已足够提供强烈的沉浸感。

关键技术组件详解

A. 头部追踪

这是实现“沉浸感”和“交互性”最关键的技术,如果头部转动时,虚拟世界的画面没有实时、准确地跟随,沉浸感”会瞬间被打破,导致严重的眩晕感,Oculus Rift 的头部追踪主要依赖两种技术:

内部传感器:惯性测量单元

-

组成: IMU 是一个小型电子设备,集成在头显内部,包含三个核心部件:

- 陀螺仪: 测量头显的旋转速度(绕 X, Y, Z 轴的角速度),当你左右摇头或点头时,陀螺仪能立刻检测到这个变化。

- 加速度计: 测量头显的线性加速度和重力方向,它可以判断头显是静止、在移动,还是朝哪个方向倾斜,通过积分,加速度计也能推算出头显的朝向。

- 磁力计: 相当于一个电子罗盘,用于测量地球磁场的方向,为头显提供一个绝对的“北方”参考,防止陀螺仪和加速度计在长时间运行后产生累积误差(漂移)。

-

工作流程:

- IMU 以非常高的频率(1000Hz)持续检测头部的微小运动。

- 这些原始数据会被发送到头显内置的处理器。

- 处理器运行一种名为传感器融合 的算法(如卡尔曼滤波),将陀螺仪、加速度计和磁力计的数据结合起来,取长补短,得出一个最准确、最稳定的头部姿态(位置和朝向)。

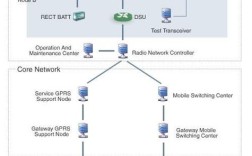

外部追踪:红外摄像头与红外 LED

-

组成:

(图片来源网络,侵删)

(图片来源网络,侵删)- 头显和控制器上: 安装有多个红外 LED 灯珠。

- 桌面上: 放置一个或多个红外摄像头(Oculus 称之为“Constellation”追踪系统),这些摄像头专门追踪红外光,对环境光不敏感。

-

工作流程:

- 头显和控制器上的红外 LED 会以特定的模式或频率闪烁。

- 桌面上的红外摄像头会捕捉这些 LED 的位置。

- 通过三角测量法,摄像头可以精确计算出头显和控制器在 3D 空间中的绝对位置(X, Y, Z 坐标)。

IMU vs. 摄像头追踪的结合:

这是 Oculus Rift 追踪系统的精髓,实现了低延迟和高精度的完美结合。

- IMU 的优势: 响应速度极快(毫秒级),非常适合捕捉快速的头部转动,但缺点是存在漂移,长时间测量后位置会不准。

- 摄像头的优势: 能够提供非常精确的绝对位置,且没有漂移,但缺点是响应速度相对较慢,且在快速转动时可能会因“运动模糊”而丢失追踪点。

协同工作:

- 高频更新: IMU 负责以极高的频率更新你的头部朝向,让你感觉画面是实时跟随的,这是消除眩晕感的关键。

- 位置校正: 摄像头系统以较低的频率(60Hz 或 120Hz)对 IMU 的数据进行“校准”和“修正”,它告诉 IMU:“嘿,根据我的观察,你的实际位置在这里,请根据这个信息调整你的漂移。”

- 结果: 这种混合追踪系统既保证了低延迟(快速响应转动),又保证了高精度(准确定位),是目前消费级 VR 追踪的最佳方案之一。

B. 立体渲染

在确定了头部位置和朝向后,计算机需要生成相应的图像。

- 渲染过程:

- 获取姿态: 游戏引擎(如 Unity, Unreal Engine)从 Oculus Rift 的 SDK(软件开发工具包)中获取由 IMU 和摄像头系统计算出的头部姿态数据。

- 生成视角: 根据这个姿态,引擎会计算出左右两眼在虚拟世界中的精确位置。

- 分别渲染: 引擎会为左眼和右眼分别渲染一张完整的场景图像,这两张图像会因为视角不同而存在细微的差别(视差)。

- 异步空间扭曲: 这是 Oculus 的一个关键技术,为了进一步降低延迟,渲染器不会等到完全渲染完一帧再显示,而是在渲染过程中,根据头部最新的微小转动,对前一帧的画面进行实时的“扭曲”校正,然后再显示出来,这相当于“预测”了你的头部运动,使得你看到的画面总是最新的,极大地减少了延迟。

C. 透镜显示与屏幕技术

渲染好的左右图像需要被正确地送到你的眼睛里。

- 屏幕: 早期开发者版本用的是一块 1080p 的屏幕,消费者版本 CV1 使用了一块 AMOLED 屏幕,分辨率为 1080x1200 每眼,AMOLED 的优势是高对比度、快速响应(几乎没有拖影),这对于减少动态画面的眩晕感至关重要。

- 透镜: 这是最巧妙的部分,它不是普通的放大镜。

- 菲涅尔透镜: Rift 使用的是菲涅尔透镜,它非常薄,由一系列同心的、像螺纹一样的刻槽组成,这种设计可以在不增加透镜厚度和重量的情况下,提供很大的放大倍率和视野。

- 功能: 透镜有两个主要作用:

- 放大: 将屏幕上靠近眼睛的小画面放大,使其填满你的视野。

- 矫正畸变: 直接把屏幕图像显示出来,边缘会有严重的桶形畸变,菲涅尔透镜经过精密设计,可以反向补偿这种畸变,让你看到的是正常的、没有变形的图像,你看到的画面边缘那些“波纹”就是透镜的纹路。

- 镜头间距 调节: 你可以通过头显上方的拨片来移动整个屏幕和透镜组件,使其与你的瞳距相匹配,确保左右图像的中心正好对准你的瞳孔,否则会出现重影或视觉疲劳。

D. 空间音频

沉浸感不仅来自视觉,也来自听觉。

- 技术: Oculus 使用了名为 Ambisonics 的高阶环绕声技术。

- 原理: 它不是简单地给左右耳机播放不同的声音,而是创建一个球形的声音场,声音的定位是相对于你的头部姿态的,一个虚拟的鸟叫声,无论你如何转动头部,它听起来都像是从你头顶的某个固定位置传来的,而不是耳机里的某个固定声道,这种“头中定位”极大地增强了声音的真实感和方向感,让你能仅凭声音判断虚拟物体的位置。

一个完整的流程

- 你转动头部。

- 头显内的 IMU 立刻检测到这个快速运动,并通过异步空间扭曲技术对上一帧画面进行实时校正,让你看到“即时”的画面,延迟极低。

- 桌面上的红外摄像头持续追踪头显上的 LED,为系统提供精确的绝对位置,校正 IMU 的长期漂移。

- 游戏引擎接收到融合后的、精确的头部姿态数据。

- 引擎为你的左眼和右眼分别渲染出视角略有不同的两幅图像。

- 这两幅图像被送到AMOLED 屏幕上。

- 菲涅尔透镜将画面放大并矫正畸变,使其正常地呈现在你的视网膜上。

- 空间音频引擎根据你的头部朝