首先需要明确一点,"SmartEye" 并不是一个像 OpenCV 或 TensorFlow 那样开源的、标准化的技术框架,它更像是一个品牌名称或一个商业化的技术解决方案,通常由特定的公司(如一些机器人或自动化领域的初创公司)提供,其核心就是利用摄像头进行环境感知和自主导航。

我们可以将 SmartEye 视觉导航技术 理解为:一套以摄像头为核心传感器,通过先进的计算机视觉和人工智能算法,赋予机器人或移动平台自主感知、定位、规划和避障能力,从而实现复杂环境中无人化自主移动的综合技术体系。

下面,我们将从核心原理、关键技术、优势、应用场景以及挑战等方面,对这项技术进行深入剖析。

核心原理:机器人如何“看见”并“理解”世界?

想象一下人类是如何在陌生环境中行走的:我们用眼睛观察周围的环境(建筑、路标、行人),结合我们已有的地图和记忆,判断自己当前的位置,然后规划一条通往目的地的路线,同时避开路上的障碍物。

SmartEye 视觉导航的原理与此类似,只不过执行者是机器人,其基本流程可以分解为以下几个关键步骤:

- 感知:通过摄像头(机器人的“眼睛”)捕捉周围环境的图像信息。

- 理解:利用图像处理和深度学习算法,从图像中提取有用的信息,例如识别路标、障碍物、可行驶区域等。

- 定位:将当前观察到的环境信息与预先构建的地图或已知特征进行比对,从而确定机器人在地图中的精确位置和姿态(即“我在哪里?”)。

- 规划:根据目标位置和当前定位,结合环境中的障碍物信息,规划出一条从当前位置到目标点的安全、最优路径(即“我该怎么走?”)。

- 控制:将规划出的路径转换成具体的运动指令(如前进、转向、停止),控制机器人的底盘或执行机构移动。

关键技术模块

SmartEye 视觉导航技术通常由以下几个核心技术模块构成:

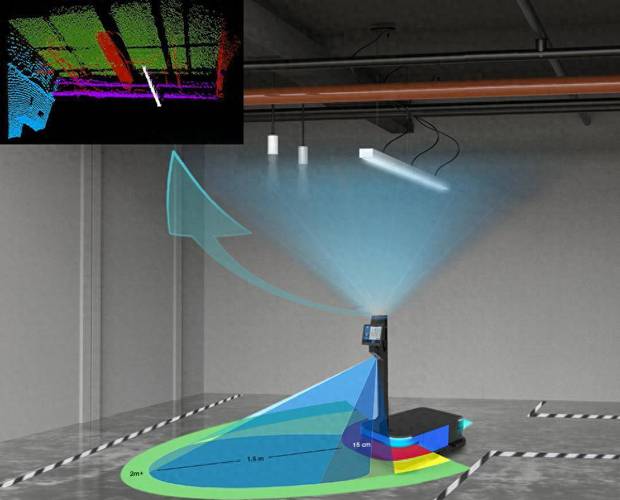

环境感知与建图

这是视觉导航的基础,机器人需要先“认识”它将要工作的环境。

- SLAM (Simultaneous Localization and Mapping) - 即时定位与地图构建:

- 核心思想:机器人在未知环境中移动时,可以一边绘制环境地图,一边利用这张地图进行自身定位,这是一个“鸡生蛋,蛋生鸡”的问题,SLAM 技术完美地解决了它。

- 视觉 SLAM (V-SLAM):这是 SmartEye 技术的核心,它利用摄像头作为唯一或主要的传感器,通过提取图像中的特征点(如角点、边缘),并在连续帧中追踪这些点的变化,来估算机器人的运动和构建环境的稀疏或稠密地图。

- 主流算法:ORB-SLAM, VINS-Fusion, LSD-SLAM 等。

定位

当地图建好后,机器人需要知道自己在地图中的精确位置。

- 视觉里程计:通过连续分析图像帧,估算机器人自身的短距离运动(平移和旋转),这是 SLAM 的一部分,但也可以独立用于短时间内的定位。

- 重定位:当机器人暂时丢失位置(例如进入一个没有特征的走廊)后,重新进入一个有丰富特征的区域时,需要快速识别出自己在哪里,视觉重定位通过将当前图像与地图中已存储的关键帧图像进行匹配,快速恢复定位。

- 基于地图的定位:在已知地图中,通过实时图像与地图特征的匹配,持续、精确地更新机器人位置。

路径规划与避障

这是机器人的“大脑”和“决策中心”。

- 全局路径规划:在已知全局地图的基础上,从起点到终点规划一条最优路径(最短、最安全等),常用算法有 A, D 等。

- 局部路径规划:根据传感器(主要是摄像头)实时感知到的周围环境信息,动态地调整和修正局部路径,以避开突然出现的障碍物(如行人、临时堆放的货物)。

- 动态障碍物跟踪与预测:利用目标检测和跟踪算法(如 YOLO, DeepSORT),识别并跟踪移动的障碍物,并预测其未来的运动轨迹,从而进行更智能的规避。

深度学习与目标识别

这是让机器人更“智能”的关键。

- 语义分割:将图像中的每个像素分类到不同的类别(如“地面”、“墙壁”、“天花板”、“障碍物”),从而让机器人理解场景的“语义”,而不仅仅是几何结构。

- 目标检测:识别图像中特定的物体,如“人”、“叉车”、“货架”、“门”等,这可以实现更高级的交互和导航逻辑(如“给人让路”、“前往货架”)。

- 场景理解:结合语义分割和目标检测,机器人可以理解整个场景的含义,这是一个货架通道,可以通行”或“这是一个交叉路口,需要小心”。

SmartEye 视觉导航的优势

相比于其他导航方式(如激光雷达导航、磁条导航、二维码导航),视觉导航具有显著优势:

| 特性 | 视觉导航 | 激光雷达导航 | 磁条/二维码导航 |

|---|---|---|---|

| 成本 | 低,摄像头是消费级产品,成本相对较低。 | 高,激光雷达,特别是高性能的,价格昂贵。 | 低,但需要前期铺设基础设施。 |

| 信息维度 | 丰富,提供彩色纹理、语义信息,场景理解能力强。 | 单一,主要提供精确的距离和几何信息(点云)。 | 极低,仅提供离散的位置点。 |

| 灵活性 | 极高,无需改造环境,可适应动态、复杂、非结构化环境。 | 高,同样无需改造环境,但对强光、透明物体敏感。 | 极低,依赖预设的物理路径,无法动态更改。 |

| 维护成本 | 低,无接触式感知,维护简单。 | 中等,机械部件(旋转镜)可能需要维护。 | 高,磁条/二维码易磨损、污染,需要定期维护和更换。 |

| 部署速度 | 快,快速部署即可开始工作。 | 快,快速部署即可开始工作。 | 慢,需要前期进行地面施工和标记。 |

典型应用场景

凭借其高灵活性和低成本优势,SmartEye 视觉导航技术被广泛应用于各个领域:

-

智慧物流与仓储:

- AMR (自主移动机器人):在仓库中自主搬运货架、包裹,与工人协同作业。

- 分拣机器人:识别不同区域的包裹并进行分拣。

-

智能制造:

- AGV (自动导引运输车):在工厂车间内精准运送物料,代替传统人工搬运。

- 质量巡检机器人:沿着生产线移动,通过视觉检测产品缺陷。

-

服务机器人:

- 送餐机器人:在餐厅、酒店中自主导航,将食物送到餐桌。

- 导览机器人:在博物馆、商场中为访客提供导航和解说。

- 消毒机器人:在医院、办公楼等环境中自主移动并进行消毒。

-

农业与安防:

- 农业机器人:在农田中自主导航,进行除草、播种、监测作物长势。

- 安防巡逻机器人:在园区、社区进行自主巡逻,监控异常情况。

挑战与局限性

尽管优势明显,SmartEye 视觉导航技术也面临一些挑战:

-

环境依赖性:

- 光照变化:过暗、过强或光照剧烈变化的环境会影响图像质量,导致算法失效。

- 纹理缺乏:在纯白墙壁、光滑地面等纹理稀少的区域,特征点难以提取,SLAM 和定位会变得困难。

- 动态环境:人流密集、物体频繁移动的环境会给定位和避障带来巨大挑战。

-

计算资源消耗大:

实时的图像处理、SLAM、目标检测等算法需要强大的计算能力(如 GPU),对机器人的硬件平台要求较高。

-

尺度问题:

纯视觉方法难以直接获得精确的深度信息(距离),容易出现尺度漂移(地图比实际大或小),通常需要结合 IMU(惯性测量单元)等其他传感器来解决这个问题。

-

算法鲁棒性:

如何在极端场景(如摄像头被短暂遮挡、遇到镜面反射等)下保持系统的稳定性和可靠性,是算法优化的重点和难点。

SmartEye 视觉导航技术是机器人领域的一项前沿且实用的技术,它以摄像头为“眼睛”,通过融合 SLAM、路径规划、深度学习等尖端算法,赋予了机器人在复杂、动态环境中自主行动的能力,其高性价比、高灵活性的特点,使其成为推动自动化、智能化在各行业落地应用的关键驱动力之一,尽管仍面临环境适应性、计算资源等方面的挑战,但随着算法的不断进步和硬件性能的提升,视觉导航正变得越来越成熟和可靠,未来应用前景无限广阔。