熊有伦院士作为我国精密测量与机器人技术领域的权威专家,其研究成果对机器人技术基础理论的发展产生了深远影响,在机器人技术基础研究中,核心要素包括机械结构设计、运动学与动力学建模、感知与控制策略以及人机交互等,而熊有伦院士团队在微纳米操作机器人、精密测量技术等方面的突破,为这些基础要素的创新发展提供了重要支撑。

机器人机械结构是实现功能的基础载体,其设计需兼顾刚度、轻量化及运动灵活性,熊有伦院士提出的“宏微结合”机器人结构理念,通过将宏观运动平台与微驱动单元相结合,解决了传统机器人在大范围作业与高精度操作间的矛盾,在手术机器人领域,宏动平台实现空间定位,微驱动单元完成亚毫米级精准操作,这种结构设计显著提升了机器人在复杂环境中的适应性,基于拓扑优化方法的轻量化设计,既降低了运动惯性,又保证了结构强度,为机器人的动态响应性能优化提供了新思路。

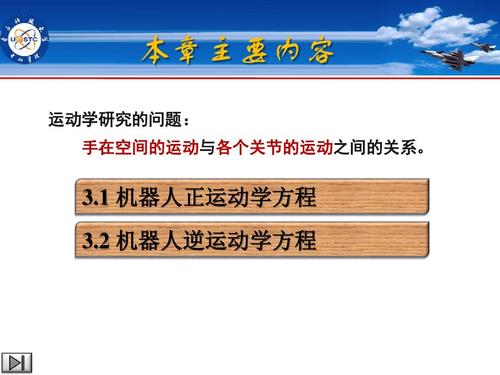

运动学与动力学建模是机器人实现精准运动的前提,熊有伦院士团队在机器人运动学标定方面提出了“分步标定法”,通过分离几何误差与非线性误差,建立了高精度的运动学模型,该方法利用激光跟踪仪等精密测量设备获取关键参数,结合最小二乘法进行参数辨识,将机器人定位精度从毫米级提升至微米级,在动力学建模中,针对变负载工况下的机器人运动控制问题,引入了自适应扰动观测器,实时补偿外部负载变化与摩擦力矩的影响,确保了机器人高速运动轨迹的稳定性,团队还研究了冗余度机器人的避奇异轨迹规划算法,通过雅可比矩阵伪逆优化,解决了传统算法在奇异位姿附近运动失控的问题。

感知系统是机器人与物理环境交互的核心环节,熊有伦院士在视觉伺服控制与多传感器融合技术方面的研究尤为突出,针对传统视觉伺服计算量大、实时性差的问题,提出了基于深度学习的特征点快速提取算法,通过卷积神经网络(CNN)训练实现了复杂光照条件下的鲁棒特征识别,将图像处理速度提升3倍以上,在触觉感知方面,研发了基于压阻效应的柔性触觉传感器阵列,可实时检测接触力的大小与分布,并利用有限元分析优化传感器结构,使其灵敏度达到0.01N,为机器人的精细操作提供了力反馈保障,多传感器融合技术则通过卡尔曼滤波算法,整合视觉、力觉、位置等多源信息,有效降低了单一传感器的噪声干扰,提升了环境感知的准确性。

控制策略是机器人实现智能决策的关键,熊有伦院士团队在自适应控制与强化学习结合方面取得显著进展,针对机器人参数时变性问题,设计了模型参考自适应控制器(MRAC),通过在线辨识系统参数动态调整控制律,使机器人适应不同负载与工况的变化,在强化学习应用中,结合模仿学习与强化学习的优势,先通过专家数据训练策略网络,再通过环境交互进行自我优化,大幅减少了强化学习的训练时间,在机器人抓取任务中,该方法仅需100次迭代即可达到90%的成功率,较传统强化学习效率提升5倍,团队还研究了人机协作中的力位混合控制策略,通过阻抗控制实现柔顺交互,确保在与人协作时的安全性。

机器人技术基础的发展离不开跨学科技术的融合,熊有伦院士团队在微纳操作领域的创新充分体现了这一点,通过将微电子机械系统(MEMS)技术与机器人控制相结合,研发了可用于细胞操作的微纳米机器人,其末端执行器尺寸仅100微米,定位精度达50纳米,在精密测量方面,团队发明的“激光共聚焦测量技术”,解决了微三维结构的形貌检测难题,测量分辨率达到纳米级,为机器人零部件的高精度加工提供了质量保障,这些跨学科研究成果不仅拓展了机器人的应用场景,也为基础理论的突破提供了实验支撑。

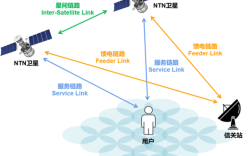

随着人工智能技术的发展,机器人技术正朝着智能化、自主化方向演进,熊有伦院士指出,未来机器人研究需重点关注“感知-决策-控制”一体化架构的优化,通过引入数字孪生技术构建虚拟映射,实现物理世界与虚拟世界的实时交互,在工业机器人领域,基于数字孪生的预测性维护可提前识别设备故障,降低停机时间30%以上;在服务机器人领域,结合环境语义理解的自主导航技术,将提升机器人在动态环境中的路径规划能力,这些研究方向不仅需要理论创新,更需要工程实践的验证,而熊有伦院士团队在精密测量与控制技术积累,为这些目标的实现奠定了坚实基础。

相关问答FAQs

Q1:熊有伦院士提出的“宏微结合”机器人结构设计有什么优势?

A1:“宏微结合”结构通过宏观运动平台实现大范围空间定位(如毫米级到米级),微驱动单元负责高精度操作(如亚微米级到微米级),两者协同工作解决了传统机器人在作业范围与精度间的矛盾,这种设计不仅提升了机器人在复杂任务(如手术、精密装配)中的适应性,还通过轻量化优化降低了能耗,同时利用拓扑优化保证了结构刚度,适用于对动态性能要求高的场景。

Q2:熊有伦团队在机器人视觉伺服控制中有哪些技术创新?

A2:团队针对传统视觉伺服实时性差的问题,创新性地将深度学习与视觉伺服结合:一是基于CNN开发特征点快速提取算法,提升复杂光照下的特征识别速度与鲁棒性;二是设计分层视觉伺服框架,高层任务规划结合底层实时控制,减少计算延迟;三是引入自适应权值融合机制,动态调整图像特征与空间位置的权重,提高抗干扰能力,这些技术使机器人视觉伺服的响应速度提升3倍以上,定位精度达微米级。