Hadoop作为大数据处理领域的核心框架,其关键技术体系构建了分布式存储与计算的基础能力,通过模块化设计解决了海量数据的存储、处理和分析问题,以下从核心组件、技术原理及创新点三个维度展开分析。

分布式文件系统(HDFS)

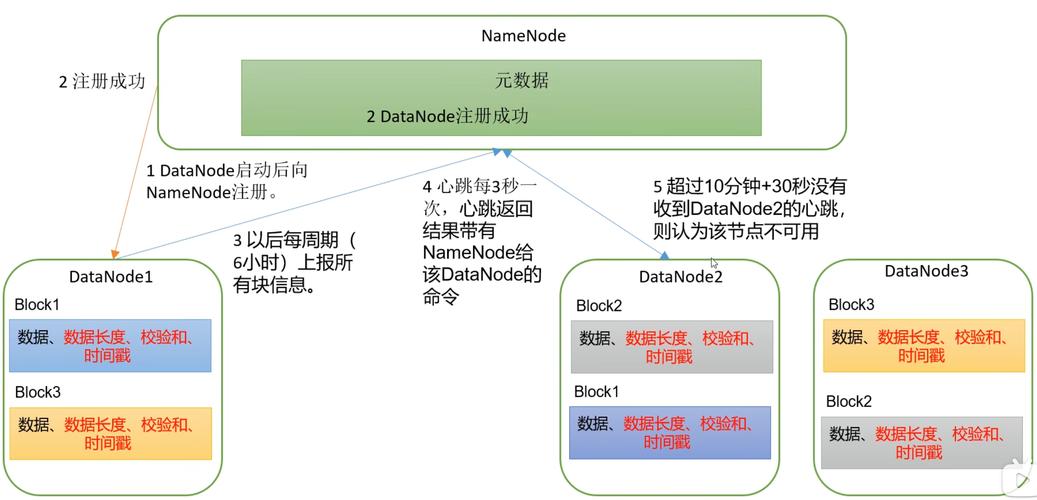

HDFS是Hadoop的存储基石,采用主从架构(Master-Slave)设计,由NameNode和DataNode组成,NameNode负责管理文件系统的元数据,包括文件名、目录结构、数据块位置等信息,存储在内存中以确保快速访问;DataNode负责存储实际数据块,默认大小为128MB(可配置),每个数据块在集群中默认保存3个副本(可通过参数调整),实现数据容错,HDFS的写入流程遵循"一次写入,多次读取"原则,客户端先从NameNode获取目标DataNode列表,然后按顺序将数据块写入各节点,最后由NameNode更新元数据,读取时,客户端直接从DataNode并行获取数据块,利用集群带宽实现高吞吐量,其设计特点包括:大文件存储(支持GB/TB级文件)、高容错性(副本机制)、流式数据访问(优化顺序读写)以及机架感知策略(副本优先存储不同机架,提升数据安全性和读取效率)。

MapReduce计算模型

MapReduce是Hadoop的核心计算框架,将分布式计算任务拆分为Map(映射)和Reduce(规约)两个阶段,Map阶段处理输入数据并生成键值对,Reduce阶段对Map输出的中间结果进行聚合,其执行流程包括:JobTracker(或ResourceManager)接收任务后,将输入数据切分成Split,分配给TaskTracker(或NodeManager)执行Map任务;Map任务输出结果经过Shuffle(排序、分区、合并)阶段后,传输到Reduce节点进行最终计算,Shuffle阶段是MapReduce的性能关键,涉及磁盘I/O、网络传输和数据排序,Hadoop通过Combiner(本地预聚合)、压缩(如Snappy、Gzip)和内存缓冲区优化等技术减少数据传输量,该模型的优势在于简化并行编程,开发者只需关注业务逻辑而非分布式细节,但缺点是延迟较高,不适合实时计算场景。

资源管理(YARN)

Yet Another Resource Negotiator(YARN)是Hadoop的资源管理框架,解决了早期MapReduce中JobTracker既负责任务调度又负责资源监控的瓶颈问题,YARN架构包含ResourceManager(全局资源管理者)和NodeManager(单节点资源管理者),ResourceManager负责集群资源分配和作业调度,采用两级调度策略(队列调度和容量调度);NodeManager负责监控节点资源(CPU、内存)并向ResourceManager汇报,同时启动和监控Container(资源容器),YARN支持多种计算框架(如Spark、Flink)通过ApplicationMaster提交作业,实现了资源的多租户共享,其创新点在于将资源管理与计算框架解耦,提升了集群资源利用率和灵活性,支持批处理、流处理、交互式查询等多种计算模式。

数据一致性机制

Hadoop通过多项技术保障数据一致性,HDFS采用基于租用的机制实现文件写入安全,客户端向NameNode获取租约后才能写入数据,避免多客户端同时修改元数据;DataNode定期向NameNode发送心跳包和块报告,NameNode根据块报告检测数据块完整性,若发现副本丢失则自动触发数据恢复,MapReduce通过任务重试机制(Task Retry)应对节点故障,若TaskTracker超时未发送心跳,ResourceManager会将该节点上的任务重新分配到其他节点,HDFS的Checkpoint机制定期将NameNode的元数据镜像从内存持久化到磁盘,并通过Secondary NameNode辅助合并EditLog与FsImage,避免元数据日志过大。

辅助生态系统技术

Hadoop的生态完善度离不开辅助技术支持,HBase作为分布式NoSQL数据库,构建于HDFS之上,提供实时随机读写能力,适用于海量结构化数据存储;ZooKeeper作为分布式协调服务,管理Hadoop集群的选举、配置同步和故障恢复,确保NameNode的高可用(通过Active-Standby模式);Hive数据仓库工具将SQL查询转换为MapReduce或Tez任务,支持类SQL数据分析;Pig提供数据流处理语言,简化ETL流程;Sqoop和Flume分别负责关系型数据库与HDFS的数据导入导出,以及实时日志数据的采集,这些组件与Hadoop核心框架协同工作,形成了覆盖数据采集、存储、处理、分析的全链路解决方案。

相关问答FAQs

Q1:HDFS与传统文件系统(如NTFS、ext4)的主要区别是什么?

A1:HDFS是分布式文件系统,专为大数据设计,支持跨多节点存储超大文件(TB/PB级),通过副本机制实现高容错;而传统文件系统为单机设计,文件大小受限于单块磁盘容量,容错能力较弱,HDFS优化了顺序读写吞吐量,延迟较高,适合批处理场景;传统文件系统支持随机读写,延迟低,适用于小文件和高并发场景。

Q2:为什么MapReduce不适合实时数据处理?

A2:MapReduce的设计初衷是批处理,其任务调度和数据Shuffle阶段涉及大量磁盘I/O和网络传输,导致任务启动延迟高(通常分钟级),实时数据处理要求毫秒级响应,而MapReduce的中间结果落地磁盘、任务重试机制等特性无法满足低延迟需求,Spark、Flink等基于内存的计算框架逐渐取代MapReduce成为实时处理的主流选择。